Size: a a a

2018 October 12

ЭВОЛЮЦИЯ МОЗГА

В состоянии покоя мозг потребляет до 25% всей расходуемой телом энергии. Для сравнения: у других приматов мозг в состоянии покоя довольствуется всего лишь 8% общих резервов. Первобытные люди дорого платили за увеличенный мозг: во-первых, они тратили больше времени на поиски пищи, а во-вторых, у них слабели мышцы.

Словно правительство, направляющее деньги на развитие образования, а не армии, люди отнимали энергию у бицепсов и отдавали ее нейронам, а это не лучшая стратегия для выживания в саванне. Ученый спор с человеком шимпанзе не выиграет, а вот разодрать его на части может запросто. Но все же это было выгодно, иначе мозговитые не дали бы еще более мозговитое потомство.

Юваль Харари, из книги «Sapiens. Краткая история человечества»

В состоянии покоя мозг потребляет до 25% всей расходуемой телом энергии. Для сравнения: у других приматов мозг в состоянии покоя довольствуется всего лишь 8% общих резервов. Первобытные люди дорого платили за увеличенный мозг: во-первых, они тратили больше времени на поиски пищи, а во-вторых, у них слабели мышцы.

Словно правительство, направляющее деньги на развитие образования, а не армии, люди отнимали энергию у бицепсов и отдавали ее нейронам, а это не лучшая стратегия для выживания в саванне. Ученый спор с человеком шимпанзе не выиграет, а вот разодрать его на части может запросто. Но все же это было выгодно, иначе мозговитые не дали бы еще более мозговитое потомство.

Юваль Харари, из книги «Sapiens. Краткая история человечества»

https://coinspot.io/interesting/talk-humor/google-proshlas-po-kriptovalyutam-v-reklame-novogo-smartfona/

это не шутка, а нативная реклама

это не шутка, а нативная реклама

КОНКУРЕНЦИЯ И ДЕФИЦИТ

Роберта Чалдини, из книги «Психология влияния»

bitcoin?

from https://t.me/PsyEducation/617

Если какие-либо ресурсы ограничиваются, особенно важную роль в стремлении к ним начинает играть конкуренция. Помимо того, что какой-либо предмет становится в наших глазах более привлекательным, когда он оказывается в дефиците, мы особенно сильно начинаем желать этот предмет. Особенно, когда вынуждены из-за него конкурировать.Роберта Чалдини, из книги «Психология влияния»

bitcoin?

В «Интернет вещей» включены пакеты трафика от 15 МБ до 300 МБ по цене от 20 до 120 рублей и специальные опции для бизнеса.

https://rb.ru/news/pervyj-tarif-iot/

https://rb.ru/news/pervyj-tarif-iot/

Этот меморандум по копирайту между медиа компаниями и поисковиками не может быть простым.

Яндекс согласилась подписать меморандум с правообладателями только при условии что:

1. Его подпишут и Mail.ru Group и

2. К заявлению будет прилагаться судебный акт

3. Заявитель теряете право обращаться в суд , либо меморандум теряет для него силу.

Позицию компании по защите от злоупотреблений можно понять.

А правообладатели говорят о возможном действий в России аналога американского DMCA. Но это чушь. Не может одновременно работать и DMCA и SOPA (американский аналог антипиратского закона, который так и не был принят в США). Для этого тогда надо отменять 4 ранее принятых версии антипиратского закона и тормозить с 5ым по счету драфтом, который вносит ещё больший дисбаланс и возможности абьюза для некоторых игроков.

➡ https://bit.ly/2EgiMAL

Яндекс согласилась подписать меморандум с правообладателями только при условии что:

1. Его подпишут и Mail.ru Group и

2. К заявлению будет прилагаться судебный акт

3. Заявитель теряете право обращаться в суд , либо меморандум теряет для него силу.

Позицию компании по защите от злоупотреблений можно понять.

А правообладатели говорят о возможном действий в России аналога американского DMCA. Но это чушь. Не может одновременно работать и DMCA и SOPA (американский аналог антипиратского закона, который так и не был принят в США). Для этого тогда надо отменять 4 ранее принятых версии антипиратского закона и тормозить с 5ым по счету драфтом, который вносит ещё больший дисбаланс и возможности абьюза для некоторых игроков.

➡ https://bit.ly/2EgiMAL

хлеба и зрелищ!

опиум для народа в своей массе будет отноительно халявным еще долго с текущим уровнем жизни

опиум для народа в своей массе будет отноительно халявным еще долго с текущим уровнем жизни

Про использование машинного обучения и нейронных сетей в частности в прогнозах Яндекс.Погоды пару лет назад много писали, а я часто рассказывал; там отличная была магия, но потом тема как-то ушла в тень; не было новостей. А ребята работали над очень красивой технологией сверлокального краткосрочного прогноза осадков на основе уже не данных метеорадаров (они далеко не везде есть), а спутниковых снимков.

И вот ее запустили и это очень красиво внутри и снаружи:)

https://habr.com/company/yandex/blog/425517/

И вот ее запустили и это очень красиво внутри и снаружи:)

https://habr.com/company/yandex/blog/425517/

http://renen.ru/solar-energy-spain-to-eliminate-sun-tax/

«Солнечным налогом» облагалось электричество, вырабатываемое малыми солнечным электростанциями мощностью от 10 кВт, в том числе та его часть, которая шла на собственное потребление владельцев. Кроме того, по действующему с 2015 г законодательству та часть солнечного электричества, которая не потреблялась, а передавалась в сеть, не оплачивалась.

Основной фокус нового постановления испанского совета министров направлен на стимулирование собственного потребления.

«Солнечным налогом» облагалось электричество, вырабатываемое малыми солнечным электростанциями мощностью от 10 кВт, в том числе та его часть, которая шла на собственное потребление владельцев. Кроме того, по действующему с 2015 г законодательству та часть солнечного электричества, которая не потреблялась, а передавалась в сеть, не оплачивалась.

Основной фокус нового постановления испанского совета министров направлен на стимулирование собственного потребления.

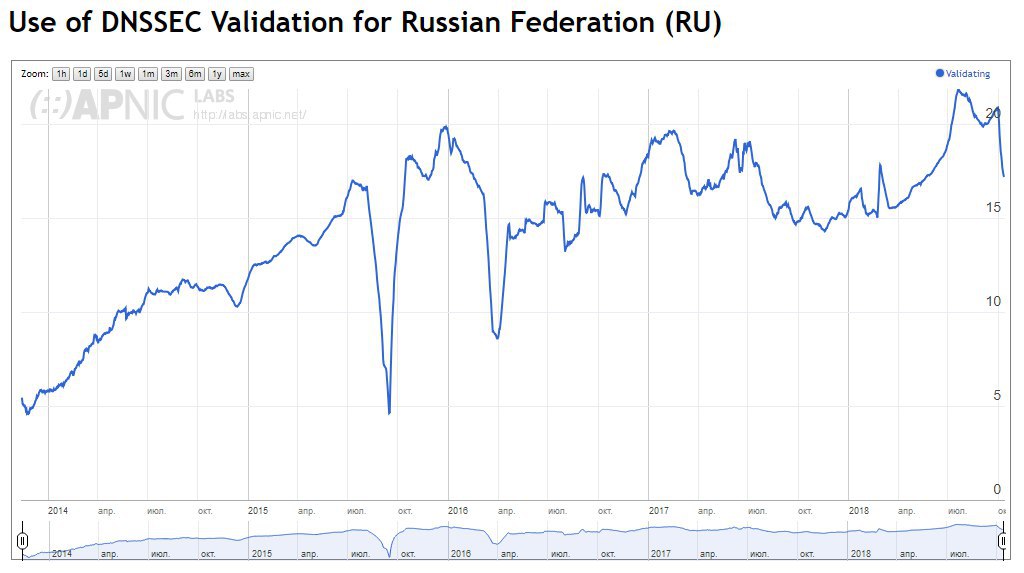

Кстати, по поводу DNSSEC в России есть вот такой график по валидации. Уровень примерно 20% от запросов, оказывается

https://stats.labs.apnic.net/dnssec/RU

https://stats.labs.apnic.net/dnssec/RU

Еще 1 сомнительная инициатива в рамках системы "ПЛАТОН":

Теперь речь идет о подключении к ней автобусов

Теперь речь идет о подключении к ней автобусов

Facebook выкатил 3D-фотографии для своего iOS-клиента. Теперь вы можете залить туда фото из портретного режима, сделанные на iPhone 7 Plus / 8 Plus / X / XS / XS Max, а они превратятся в псевдо-объемные. Их можно будет смотреть на любом телефоне, управляя углом обзора с помощью гироскопа. Ну и в VR на платформе Oculus.

В будущем обещают поддержку других телефонов.

https://techcrunch.com/2018/10/11/facebook-3d-photos/

В будущем обещают поддержку других телефонов.

https://techcrunch.com/2018/10/11/facebook-3d-photos/

Американское агентство по борьбе с финансовыми преступлениями (FinCEN) призывает американские биржи отказаться от сотрудничества с Ираном по использованию криптовалют для обхода экономических санкций.

https://bitnovosti.com/2018/10/12/fincen-obvinyaet-iran-v-nezakonnom-ispolzovanii-kriptovalyut-dlya-obhoda-ekonomicheskih-sanktsij/

дальше будет интереснее, это только начало

https://bitnovosti.com/2018/10/12/fincen-obvinyaet-iran-v-nezakonnom-ispolzovanii-kriptovalyut-dlya-obhoda-ekonomicheskih-sanktsij/

дальше будет интереснее, это только начало

Жители трех муниципалитетов Подмосковья старше 60 лет смогут бесплатно пользоваться интернетом, благодаря пилотному проекту Минсоцразвития Московской области. Министерство социального развития Московской области запускает проект в рамках соцподдержки пожилых людей в Подмосковье. Новый проект создан для граждан старше 60 лет, проживающих в городах Электрогорск, Куровское и деревне Давыдово городского округа Ликино-Дулево.

Бесплатный интернет предоставляется при наличии регистрации на Региональном портале государственных и муниципальных услуг Московской области и при условии предоставления документа, подтверждающего окончание курсов компьютерной грамотности на базе университетов третьего возраста. Это пилотный проект, и пока он доступен на трех территориях восточного Подмосковья.

http://mosreg.ru/sobytiya/novosti/news-submoscow/pozhilye-zhiteli-iz-3-munitsipalitetov-podmoskovya-budut-besplatno-polzovatsya-internetom

Бесплатный интернет предоставляется при наличии регистрации на Региональном портале государственных и муниципальных услуг Московской области и при условии предоставления документа, подтверждающего окончание курсов компьютерной грамотности на базе университетов третьего возраста. Это пилотный проект, и пока он доступен на трех территориях восточного Подмосковья.

http://mosreg.ru/sobytiya/novosti/news-submoscow/pozhilye-zhiteli-iz-3-munitsipalitetov-podmoskovya-budut-besplatno-polzovatsya-internetom

DARPA проиграла. А Алла Пугачева оказалась права

В мае я рассказывал, что DARPA пытается победить «глубокие фейки» (подмена лиц на видео), но, похоже, что эта битва уже проиграна. Спустя 4 месяца это окончательно подтвердилось. За широкое применение технологий «глубоких фейков» проголосовала индустрия развлечений.

Менее чем за год свершился ракетообразный взлет популярности этого класса технологий:

- от вставки лиц знаменитостей в порно-роликах;

- через создание фейковых видео-новостей;

- до превращения в один из самых прикольных и креативных видео-эффектов при создании музыкальных клипов.

Угнаться за креативом индустрии развлечений вояки из DARPA не смогут. А профи из креативных студий за несколько месяцев показали, что могут с помощью «глубоких фейков» не только экономить при съемках миллионы, но и творить до того невозможное – сплавлять вкусы разных поколений, поднимая популярность дипфейкового стиля клипов на недосягаемую ранее высоту.

Вот ролик ”1999" - идеальный пример использования «глубоких фейков», в котором Charli и Troye Sivan заставляют работать на себя идолов 1990-х: от Стива Джобса, до фильма «Титаник».

А здесь подробности этой темы.

В 1996 году на фестивале «Фантазия-96» (в проведении которого ключевую роль играла моя тогдашняя компания Silicon Graphics), я спросил Аллу Пугачеву, чего она больше всего опасается в компьютеризованном будущем индустрии развлечений.

Примадонна, получившая по итогам фестиваля приз за лучший анимационный клип «Зайка моя» (представлявшийся ею совместно с совсем молодым Киркоровым) уже тогда была в курсе огромных возможностей компьютерной графики, проиллюстрированных ей на демороликах Silicon Graphics.

И она ответила на мой вопрос, что больше всего ей не хотелось бы, чтобы её образ был использован в порно-роликах, библиотеках виртуального секса и поддельных музыкальных клипах с её, якобы, участием.

Права оказалась Алла Борисовна. Прошло 2 десятка лет, и теперь все это не только возможно, но и входит в мейнстрим индустрии развлечений.

Мой майский пост про «глубокие фейки»/

#Deepfakes

В мае я рассказывал, что DARPA пытается победить «глубокие фейки» (подмена лиц на видео), но, похоже, что эта битва уже проиграна. Спустя 4 месяца это окончательно подтвердилось. За широкое применение технологий «глубоких фейков» проголосовала индустрия развлечений.

Менее чем за год свершился ракетообразный взлет популярности этого класса технологий:

- от вставки лиц знаменитостей в порно-роликах;

- через создание фейковых видео-новостей;

- до превращения в один из самых прикольных и креативных видео-эффектов при создании музыкальных клипов.

Угнаться за креативом индустрии развлечений вояки из DARPA не смогут. А профи из креативных студий за несколько месяцев показали, что могут с помощью «глубоких фейков» не только экономить при съемках миллионы, но и творить до того невозможное – сплавлять вкусы разных поколений, поднимая популярность дипфейкового стиля клипов на недосягаемую ранее высоту.

Вот ролик ”1999" - идеальный пример использования «глубоких фейков», в котором Charli и Troye Sivan заставляют работать на себя идолов 1990-х: от Стива Джобса, до фильма «Титаник».

А здесь подробности этой темы.

В 1996 году на фестивале «Фантазия-96» (в проведении которого ключевую роль играла моя тогдашняя компания Silicon Graphics), я спросил Аллу Пугачеву, чего она больше всего опасается в компьютеризованном будущем индустрии развлечений.

Примадонна, получившая по итогам фестиваля приз за лучший анимационный клип «Зайка моя» (представлявшийся ею совместно с совсем молодым Киркоровым) уже тогда была в курсе огромных возможностей компьютерной графики, проиллюстрированных ей на демороликах Silicon Graphics.

И она ответила на мой вопрос, что больше всего ей не хотелось бы, чтобы её образ был использован в порно-роликах, библиотеках виртуального секса и поддельных музыкальных клипах с её, якобы, участием.

Права оказалась Алла Борисовна. Прошло 2 десятка лет, и теперь все это не только возможно, но и входит в мейнстрим индустрии развлечений.

Мой майский пост про «глубокие фейки»/

#Deepfakes