DB

Size: a a a

2019 June 15

можешь глянуть в этот канал

DB

там множество ссылок в хистори

U

можешь глянуть в этот канал

Спасибо)

e

И на юриста в сфере ИИ , где нибудь обучают на базе юр. вышки?

AT

И на юриста в сфере ИИ , где нибудь обучают на базе юр. вышки?

В Эдинбурге в рамках магистратуры (можно дистанционно) есть курс Регулирование автономных систем

AT

с 2014 года

AT

И на юриста в сфере ИИ , где нибудь обучают на базе юр. вышки?

OK

Тем временем забавный хайп вокруг нейросети GPT-2 продолжается (сначала кратко напомню предысторию для тех кто не в курсе).

В прошлом году появилось несколько мощных нейросетевых моделей на базе Transformer-ов, предобученных на больших текстовых корпусах, в том числе гугловский BERT и GPT от OpenAI. Последняя -- это такая language model сетка, которая умеет генерировать правдоподобное на первый взгляд продолжение любого префиксного текста. Т.е. там, конечно же, тоже шизофазия, как и во всех предыдущих попытках такого рода, вроде марковских цепей и RNN, но шизофазия уже значительно более высокого качества.

В феврале этого года создатели GPT-1 сделали странное движение -- они выпустили статью про GPT-2 (существенно расширенную версию GPT-1, но расширенную в основном экстенсивно), а вместо выкладывания обученной модели созвали шумную журналистскую пресс-конференцию в духе "человечество не готово к такого уровня технологиям" и "мы встанем живым щитом на пути порождённой нами опасности". Короче, модель не выложили, точнее выложили существенно уменьшенную версию. Народ в отрасли немного удивился такому дешёвому набросу, пошумел по соцсеточкам пару недель и успокоился.

Далее, ребята из OpenAI, видимо, решили подогревать этот хайп сколько можно, и в мае, за пару дней до ICLR 2019 они выложили "medium version of GPT-2", т.е. предобученную модель побольше, но всё же не ту, о которой писали в феврале. В кулуарах самой ICLR 2019 они заговорщически обещали со временем рассмотреть заявки с просьбами доступа к большой модели, полученные на специальный адрес.

Но, как писал Станислав Лем, в науке не бывает закрытий, только открытия: полторы недели назад некто Connor Leahy сообщил миру, что обучил полную модель GPT-2 с нуля и опубликует её 1 июля, если ему не предоставят самолёт^W убедительных аргументов против этого. Обсуждения проходят в твиттер-треде и в паре медиумных постов (раз, два).

Наблюдаем за развитием событий, а тем временем можно посмотреть на что способны маленькие версии моделей такого рода:

* онлайн ADnD игра, где роль мастера выполняет small GPT-2

* онлайн текстовый редактор с функцией "против писательского блока", по табу предлагающий несколько вариантов развития текста. Small/medium GPT-2.

* тредик на реддите, полностью сгенерированный моделью (тут подробнее про процесс генерации)

UPD: Я протупил последнее сообщение от Connor Leahy — он передумал выкладывать модель ;) Цирк продолжается!

В прошлом году появилось несколько мощных нейросетевых моделей на базе Transformer-ов, предобученных на больших текстовых корпусах, в том числе гугловский BERT и GPT от OpenAI. Последняя -- это такая language model сетка, которая умеет генерировать правдоподобное на первый взгляд продолжение любого префиксного текста. Т.е. там, конечно же, тоже шизофазия, как и во всех предыдущих попытках такого рода, вроде марковских цепей и RNN, но шизофазия уже значительно более высокого качества.

В феврале этого года создатели GPT-1 сделали странное движение -- они выпустили статью про GPT-2 (существенно расширенную версию GPT-1, но расширенную в основном экстенсивно), а вместо выкладывания обученной модели созвали шумную журналистскую пресс-конференцию в духе "человечество не готово к такого уровня технологиям" и "мы встанем живым щитом на пути порождённой нами опасности". Короче, модель не выложили, точнее выложили существенно уменьшенную версию. Народ в отрасли немного удивился такому дешёвому набросу, пошумел по соцсеточкам пару недель и успокоился.

Далее, ребята из OpenAI, видимо, решили подогревать этот хайп сколько можно, и в мае, за пару дней до ICLR 2019 они выложили "medium version of GPT-2", т.е. предобученную модель побольше, но всё же не ту, о которой писали в феврале. В кулуарах самой ICLR 2019 они заговорщически обещали со временем рассмотреть заявки с просьбами доступа к большой модели, полученные на специальный адрес.

Но, как писал Станислав Лем, в науке не бывает закрытий, только открытия: полторы недели назад некто Connor Leahy сообщил миру, что обучил полную модель GPT-2 с нуля и опубликует её 1 июля, если ему не предоставят самолёт^W убедительных аргументов против этого. Обсуждения проходят в твиттер-треде и в паре медиумных постов (раз, два).

Наблюдаем за развитием событий, а тем временем можно посмотреть на что способны маленькие версии моделей такого рода:

* онлайн ADnD игра, где роль мастера выполняет small GPT-2

* онлайн текстовый редактор с функцией "против писательского блока", по табу предлагающий несколько вариантов развития текста. Small/medium GPT-2.

* тредик на реддите, полностью сгенерированный моделью (тут подробнее про процесс генерации)

UPD: Я протупил последнее сообщение от Connor Leahy — он передумал выкладывать модель ;) Цирк продолжается!

DP

ну, модель помнит уже несколько последних предложений и контекст в них. уже намного лучше. раньше модель помнила где-то полпредложения

B

🔫 User кикнут — вернуть этого пользователя можно только разбаном в настройках чата.

Проголосовавшие за кик:

@me_ow_me_ow, @DefragmentedPanda, @Sergio1881, @OlegSmartHome, Ncado

Проголосовавшие за кик:

@me_ow_me_ow, @DefragmentedPanda, @Sergio1881, @OlegSmartHome, Ncado

2019 June 16

MS

CVPR is coming! Here's a hot submission on speech-to-gesture prediction. Does it have an Italian mode?

▶️ youtu.be/xzTE5sobpFY

🔎 people.eecs.berkeley.edu/~shiry/projects/speech2gesture

📉 @loss_function_porn

▶️ youtu.be/xzTE5sobpFY

🔎 people.eecs.berkeley.edu/~shiry/projects/speech2gesture

📉 @loss_function_porn

MS

Тем временем забавный хайп вокруг нейросети GPT-2 продолжается (сначала кратко напомню предысторию для тех кто не в курсе).

В прошлом году появилось несколько мощных нейросетевых моделей на базе Transformer-ов, предобученных на больших текстовых корпусах, в том числе гугловский BERT и GPT от OpenAI. Последняя -- это такая language model сетка, которая умеет генерировать правдоподобное на первый взгляд продолжение любого префиксного текста. Т.е. там, конечно же, тоже шизофазия, как и во всех предыдущих попытках такого рода, вроде марковских цепей и RNN, но шизофазия уже значительно более высокого качества.

В феврале этого года создатели GPT-1 сделали странное движение -- они выпустили статью про GPT-2 (существенно расширенную версию GPT-1, но расширенную в основном экстенсивно), а вместо выкладывания обученной модели созвали шумную журналистскую пресс-конференцию в духе "человечество не готово к такого уровня технологиям" и "мы встанем живым щитом на пути порождённой нами опасности". Короче, модель не выложили, точнее выложили существенно уменьшенную версию. Народ в отрасли немного удивился такому дешёвому набросу, пошумел по соцсеточкам пару недель и успокоился.

Далее, ребята из OpenAI, видимо, решили подогревать этот хайп сколько можно, и в мае, за пару дней до ICLR 2019 они выложили "medium version of GPT-2", т.е. предобученную модель побольше, но всё же не ту, о которой писали в феврале. В кулуарах самой ICLR 2019 они заговорщически обещали со временем рассмотреть заявки с просьбами доступа к большой модели, полученные на специальный адрес.

Но, как писал Станислав Лем, в науке не бывает закрытий, только открытия: полторы недели назад некто Connor Leahy сообщил миру, что обучил полную модель GPT-2 с нуля и опубликует её 1 июля, если ему не предоставят самолёт^W убедительных аргументов против этого. Обсуждения проходят в твиттер-треде и в паре медиумных постов (раз, два).

Наблюдаем за развитием событий, а тем временем можно посмотреть на что способны маленькие версии моделей такого рода:

* онлайн ADnD игра, где роль мастера выполняет small GPT-2

* онлайн текстовый редактор с функцией "против писательского блока", по табу предлагающий несколько вариантов развития текста. Small/medium GPT-2.

* тредик на реддите, полностью сгенерированный моделью (тут подробнее про процесс генерации)

UPD: Я протупил последнее сообщение от Connor Leahy — он передумал выкладывать модель ;) Цирк продолжается!

В прошлом году появилось несколько мощных нейросетевых моделей на базе Transformer-ов, предобученных на больших текстовых корпусах, в том числе гугловский BERT и GPT от OpenAI. Последняя -- это такая language model сетка, которая умеет генерировать правдоподобное на первый взгляд продолжение любого префиксного текста. Т.е. там, конечно же, тоже шизофазия, как и во всех предыдущих попытках такого рода, вроде марковских цепей и RNN, но шизофазия уже значительно более высокого качества.

В феврале этого года создатели GPT-1 сделали странное движение -- они выпустили статью про GPT-2 (существенно расширенную версию GPT-1, но расширенную в основном экстенсивно), а вместо выкладывания обученной модели созвали шумную журналистскую пресс-конференцию в духе "человечество не готово к такого уровня технологиям" и "мы встанем живым щитом на пути порождённой нами опасности". Короче, модель не выложили, точнее выложили существенно уменьшенную версию. Народ в отрасли немного удивился такому дешёвому набросу, пошумел по соцсеточкам пару недель и успокоился.

Далее, ребята из OpenAI, видимо, решили подогревать этот хайп сколько можно, и в мае, за пару дней до ICLR 2019 они выложили "medium version of GPT-2", т.е. предобученную модель побольше, но всё же не ту, о которой писали в феврале. В кулуарах самой ICLR 2019 они заговорщически обещали со временем рассмотреть заявки с просьбами доступа к большой модели, полученные на специальный адрес.

Но, как писал Станислав Лем, в науке не бывает закрытий, только открытия: полторы недели назад некто Connor Leahy сообщил миру, что обучил полную модель GPT-2 с нуля и опубликует её 1 июля, если ему не предоставят самолёт^W убедительных аргументов против этого. Обсуждения проходят в твиттер-треде и в паре медиумных постов (раз, два).

Наблюдаем за развитием событий, а тем временем можно посмотреть на что способны маленькие версии моделей такого рода:

* онлайн ADnD игра, где роль мастера выполняет small GPT-2

* онлайн текстовый редактор с функцией "против писательского блока", по табу предлагающий несколько вариантов развития текста. Small/medium GPT-2.

* тредик на реддите, полностью сгенерированный моделью (тут подробнее про процесс генерации)

UPD: Я протупил последнее сообщение от Connor Leahy — он передумал выкладывать модель ;) Цирк продолжается!

Cпасибо, интересный пост

DP

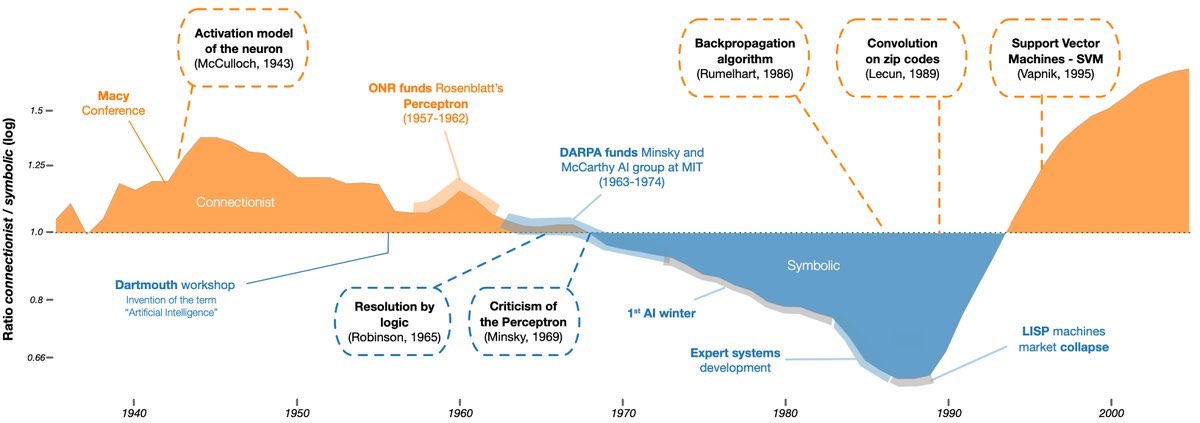

"80 years of AI research. Epic battle between connectionist (~neural networks) and symbolic (~rule based) methods. Who will win?"

👤 @OriolVinyalsML (twitter)

📉 @loss_function_porn

👤 @OriolVinyalsML (twitter)

📉 @loss_function_porn

DP

Symbolic (blue) or connectionist (orange) ?

OK

OK

мне одному кажется, что при сохранении темпов развития нейросетей, актёры перестанут быть нужны?

OK

нейросеть сгенерирует приятное личико, которое будет нравится всем, нейросеть сгенерирует звук, нейросеть сгенерирует движение, мимику и т.д., причём заведомо такие, которые понравятся зрителям

DB

так и будет

OK

толтко сценаристы и режисёры продержаться дольше актёров