KA

Size: a a a

2020 April 17

А потом в компании появился отдел DevOps

о, верной дорогой!!! )))

А

вроде как в ceph есть понятие cache tiering, если я как раз сделаю такие диски на ssd по 200-500gb (как раз столько примерно пишет одна нода в неделю), то вся запись и чтение того что только что было записанно в приоритете окажется на этих нодах, а в фоне он сделает реплику в другой дц с большими hdd. Эти ноды под которые кеш нужен не то чтобы большие объемы пишут, просто он эти файлы потом читает по 3-4 раза и очень не хочется чтобы он их читал из другого дц, так как там критично время. (грубо говоря взять 150 фоток, пережать и запихнуть в pdf, отдать клиенту).

А

почему может не работать такая схема?

AS

вроде как в ceph есть понятие cache tiering, если я как раз сделаю такие диски на ssd по 200-500gb (как раз столько примерно пишет одна нода в неделю), то вся запись и чтение того что только что было записанно в приоритете окажется на этих нодах, а в фоне он сделает реплику в другой дц с большими hdd. Эти ноды под которые кеш нужен не то чтобы большие объемы пишут, просто он эти файлы потом читает по 3-4 раза и очень не хочется чтобы он их читал из другого дц, так как там критично время. (грубо говоря взять 150 фоток, пережать и запихнуть в pdf, отдать клиенту).

говно

AS

даже разрабы цефа так говорят, но чуть более вежливо

А

говно, но терпимо и работает, или прям совсем все ломаться будет?

AS

говно, но терпимо и работает, или прям совсем все ломаться будет?

сначала терпимо работает а потом будет ломаться

AS

в чате однако есть один человек который о нем сносно отзывается

А

я так понимаю что говно когда рандомный доступ и ему приходится ребалансить

А

а если только к последним записанным то вроде норм должно быть? это узкий объем данных, при чем вероятно меньше 100-500гигов, дальше вероятность чтения падает раз в 100

ВН

При таком в принципе да, возможно

ВН

Другое дело, а какая скорость канала в другой дц?

ВН

И задержка

А

питер-hetzner

А

но говорю, там объем данных не очень большой, гигов 200 в неделю

А

и спустя неделю с вероятностью 95% уже никто не будет читать

А

при этом накопилось за все время 120TB, и в любой момент могут запросить случайный документ, но редко

IF

мужики, реально хватит уже )

IF

ceph между дц, это сразу не вариант. И ни какой cache tier вам не поможет, он для другого

А

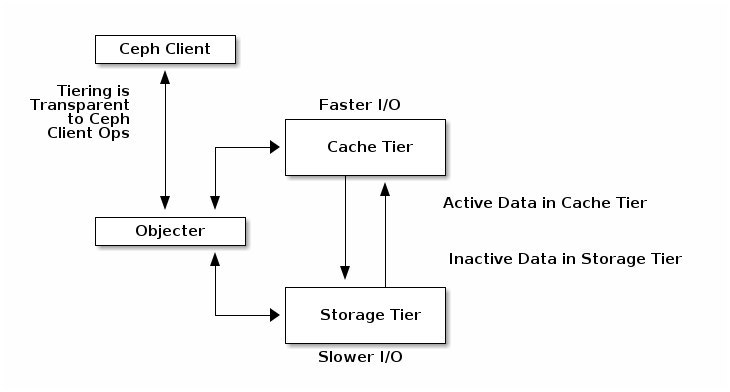

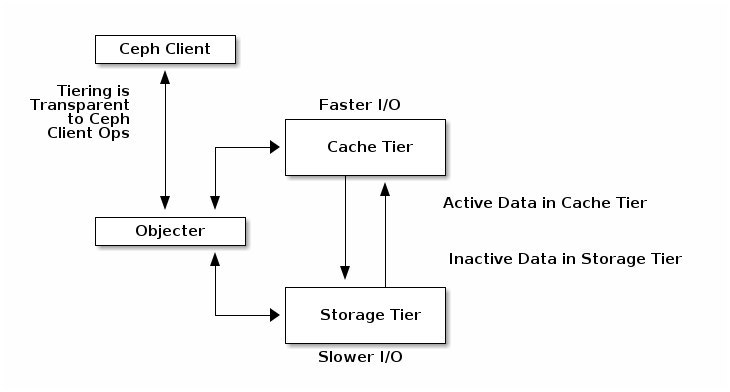

просто вроде это как раз то что я хочу

Writeback Mode: When admins configure tiers with writeback mode, Ceph clients write data to the cache tier and receive an ACK from the cache tier. In time, the data written to the cache tier migrates to the storage tier and gets flushed from the cache tier. Conceptually, the cache tier is overlaid “in front” of the backing storage tier. When a Ceph client needs data that resides in the storage tier, the cache tiering agent migrates the data to the cache tier on read, then it is sent to the Ceph client. Thereafter, the Ceph client can perform I/O using the cache tier, until the data becomes inactive. This is ideal for mutable data (e.g., photo/video editing, transactional data, etc.).