всем привет, парни, подскажите, такие качели это нормально?

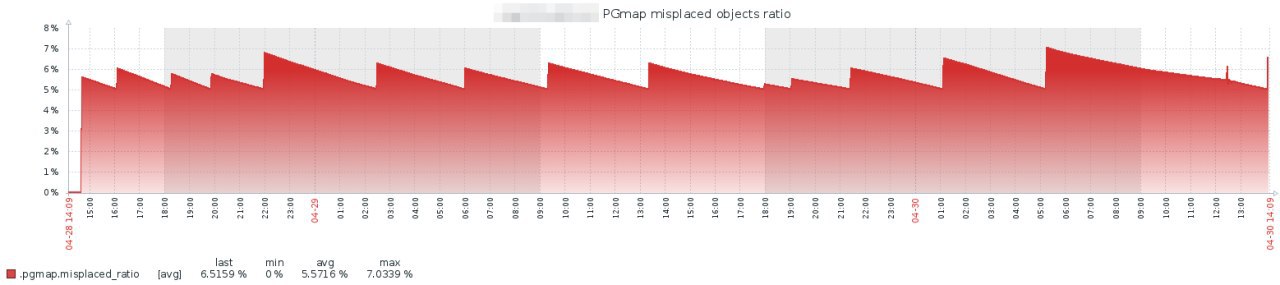

увеличил кол-во пг в пуле, цеф второй день ребалансится. как misplaced ratio опускается ниже 5% - накидывает еще 1-2% сверху и начинает все опять. картинка в статусе плюс-минус одинаковая все это время:

data:

pools: 9 pools, 337 pgs

objects: 159.89M objects, 8.4 TiB

usage: 28 TiB used, 26 TiB / 55 TiB avail

pgs: 31091758/479666970 objects misplaced (6.482%)

315 active+clean

17 active+remapped+backfilling

5 active+remapped+backfill_wait