Организаторы конференции

PLDI попросили меня её прорекламировать.

Эта одна из двух-трёх лучших конференций по языкам программирования. В этом году у неё очень интересная программа

и не потому, что мне повезло быть соавтором двух статей на ней, а участие бесплатно, но

требуется регистрация, которая закрывается уже 5го июня.

Ниже сообщение от главы программного комитета PLDI.

======

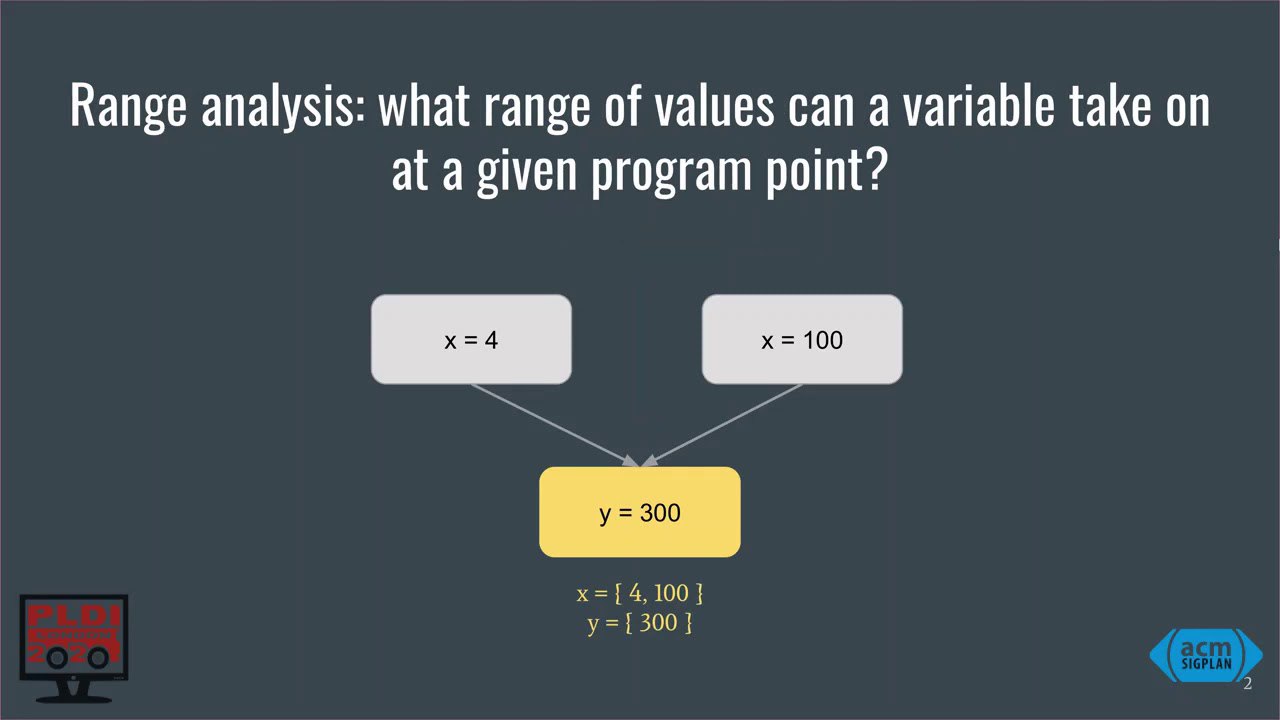

This year’s ACM SIGPLAN Conference on Programming Language Design and Implementation (PLDI) is going to run as a virtual conference during 15-20 June.

Registration for the conference closes on 5 June, and registration is free.

We have an exciting program of technical papers, as well as “Ask Me Anything” sessions with 16 special guests,

including Chris Lattner (founder of the LLVM project), Kathryn McKinley (a world leader in automated memory management techniques), Simon Peyton Jones (a major contributor to the Haskell language) and Bjarne Stroustrup (creator of C++).

You can see the complete program, and details on how to register, at the PLDI 2020 website:

https://pldi20.sigplan.org/The conference will be delivered as a Zoom webinar and there will be a dedicated Slack workspace to support interaction.

Joining instructions for Zoom and Slack will be provided after registration, and this video illustrates how the conference will work:

https://www.doc.ic.ac.uk/~afd/AboutPLDISmall.mp4We would like our virtual conference to reach the widest possible international audience, so please help us to spread the word!

I hope to see you at virtual PLDI in June!

Alastair Donaldson, PLDI 2020 General Chair

P.S. Check out our PLDI song:

https://www.doc.ic.ac.uk/~afd/PLDISongSmall.mp4 (on Youtube:

https://youtu.be/hVMCl64Uhe8)