Size: a a a

2019 May 28

Я сегодня подрисовала ребят из редакции, которые реально с нашим флагом выступили в забеге! Спорт рулит, ребята -молодцы, художник я так себе, но, как говорится «захотела и сделала!»

СМИ сообщили, что режиссер Павел Лунгин попал в реанимацию.

❗️В больнице, где находится режиссёр, "Говорит Москва" сообщили, что он проходит плановое обследование и лежит в обычной палате.

❗️В больнице, где находится режиссёр, "Говорит Москва" сообщили, что он проходит плановое обследование и лежит в обычной палате.

2019 May 29

Чёрт! Не было никакой квалифицированной психиатрической помощи! От кого охранять в Вольске (да и в других местах) школу? Я знаю! От родителей (мы всегда толпимся на крылечке) и самих учащихся (см керчь и прочие места). Школьники с расправой идут в СВОИ школы. Я знаю, что сейчас начнётся. Ограждения как в ленинградском зоопарке у орангутанов. Там оно такое, что самих обезъян не видно. https://govoritmoskva.ru/news/199400/

Ликсутов в эфире сейчас. С 10 до 11 утра. Присылайте ваши вопросы на смс +7(926)88-88-94-8

Экипаж на подводной лодке был суровый, мужской, поэтому свадьбы там случались редко...

https://t.me/radiogovoritmoskva/14420

https://t.me/radiogovoritmoskva/14420

2019 May 31

Это как предложить жениться, наверное. Волнительно. Предложили и ждем, что ответят? (лично у меня сердечко бьется, да). https://www.rbc.ru/rbcfreenews/5cf0b7b39a79478458967eed?utm_source=yxnews&utm_medium=desktop

По КНДР. Задала вопрос приятелям, которые, как я думала, следять за северокорейской прессой. Спросила, есть ли там информация, живы ли дипломаты. И получила, в частности, такой ответ: "Привет! Есть скорее всего у Ким Чен Ына, но он что-то молчит!) Скорее всего конечно вброс суровый и беспощадный, жаль мало подробностей. Скорее всего конечно забили перьевыми ручками, как инструментом дипломатии в назидание будущим поколениям)". Ну, помним, что у них там постоянная информационная война. Однако, если товарища Ким Хек Чхоля мы больше не увилим на переговорах, то ... https://ria.ru/20190531/1555131230.html?utm_source=yxnews&utm_medium=desktop

Никакого Летова.

Наткнулся на отрытое письмо от известного ML-инженера из Канады которое называется «Горький урок», попробую пересказать его тезисно – если вам не интересна тема ML, можно пропустить пост:

– Стоимость «вычислительной операции» с каждым годом уменьшается;

– За 70 лет исследований ИИ, все прорывы в сфере ИИ связаны с теми моментами когда ученые значительно повышали вычислительные мощности «базовых алгоритмов» с помощью оборудования. Deep blue (Шахматы), Alpha Go (Игра Го) все это примеры алгоритмов когда ученые решали задачу не путем попытки научить алгоритм «мыслить» как человек, а инвестируя в вычислительные мощности;

– ИИ-инженеры пишут алгоритмы которые пытаются повторить «человеческие» способы обработки и получения данных, это приятная задача для ИИ-инженера, но долгосрочно она не принесет результата или результат будет хуже чем у «базовых алгоритмов»;

– «Горький урок» в том, что простые алгоритмы которые масштабируются если добавить вычислительных мощностей всегда лучше, чем «сложные алгоритмы». С вычислительными мощностями нет проблем сейчас и не будет в будущем.

– И еще урок в том, что человеческий мозг очень сложный механизм, нам нужно перестать самим писать алгоритмы которые пытаются «повторить» какие-то части этой бесконечно сложной системы. Нам лучше сфокусироваться на алгоритмах, которые помогут найти и описать принципы работы мышления, а не самим, людишкам, питаться написать такие принципы – у нас не получается, потому что система которую мы пытаемся описать огромна и сложна, и ее по хорошему должны описывать роботы.

В общем, если ваш алгоритм показывает эффективность при увеличении вычислительной мощности, вы клевый ML-инженер.

Оригинал письма:

http://www.incompleteideas.net/IncIdeas/BitterLesson.html

– Стоимость «вычислительной операции» с каждым годом уменьшается;

– За 70 лет исследований ИИ, все прорывы в сфере ИИ связаны с теми моментами когда ученые значительно повышали вычислительные мощности «базовых алгоритмов» с помощью оборудования. Deep blue (Шахматы), Alpha Go (Игра Го) все это примеры алгоритмов когда ученые решали задачу не путем попытки научить алгоритм «мыслить» как человек, а инвестируя в вычислительные мощности;

– ИИ-инженеры пишут алгоритмы которые пытаются повторить «человеческие» способы обработки и получения данных, это приятная задача для ИИ-инженера, но долгосрочно она не принесет результата или результат будет хуже чем у «базовых алгоритмов»;

– «Горький урок» в том, что простые алгоритмы которые масштабируются если добавить вычислительных мощностей всегда лучше, чем «сложные алгоритмы». С вычислительными мощностями нет проблем сейчас и не будет в будущем.

– И еще урок в том, что человеческий мозг очень сложный механизм, нам нужно перестать самим писать алгоритмы которые пытаются «повторить» какие-то части этой бесконечно сложной системы. Нам лучше сфокусироваться на алгоритмах, которые помогут найти и описать принципы работы мышления, а не самим, людишкам, питаться написать такие принципы – у нас не получается, потому что система которую мы пытаемся описать огромна и сложна, и ее по хорошему должны описывать роботы.

В общем, если ваш алгоритм показывает эффективность при увеличении вычислительной мощности, вы клевый ML-инженер.

Оригинал письма:

http://www.incompleteideas.net/IncIdeas/BitterLesson.html

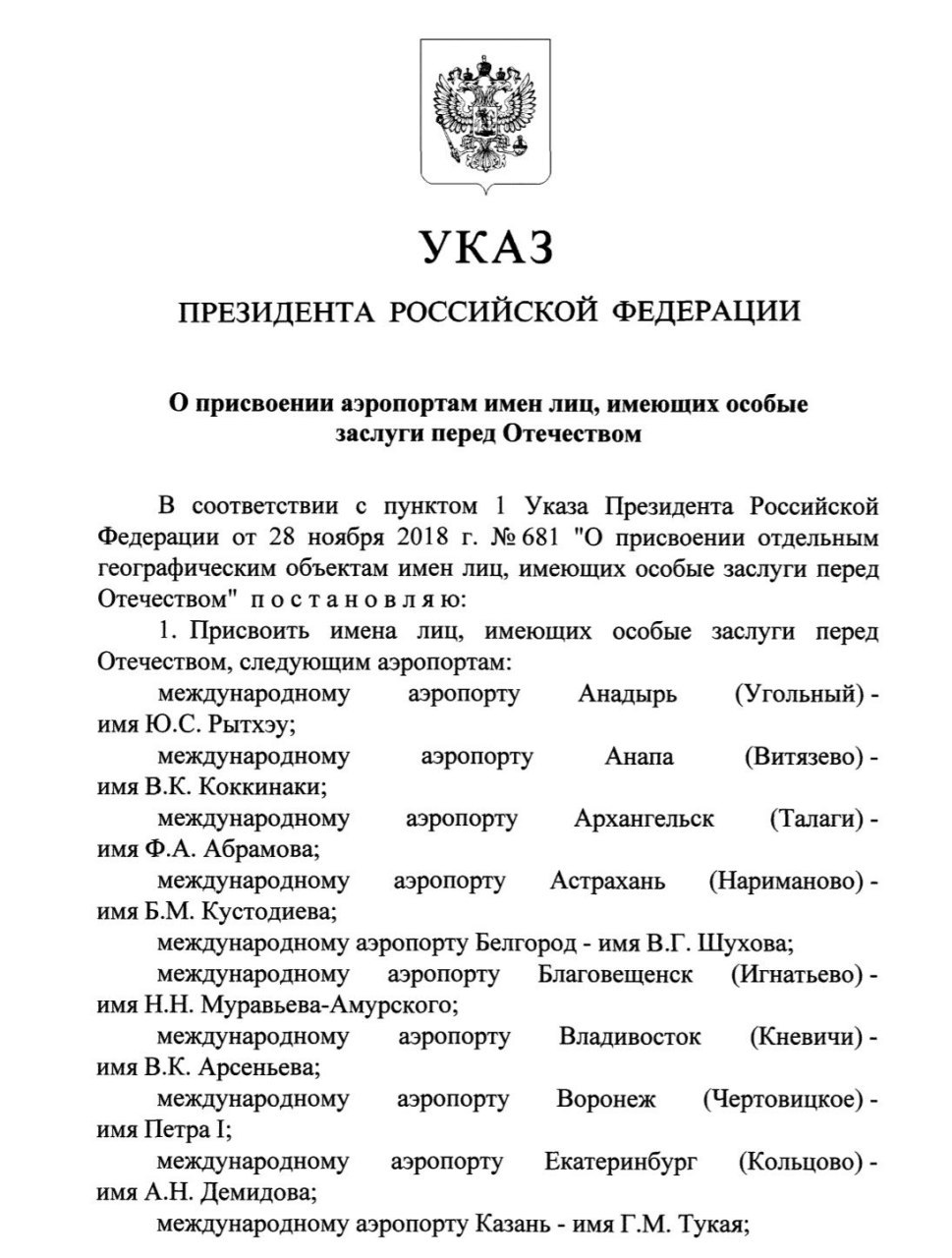

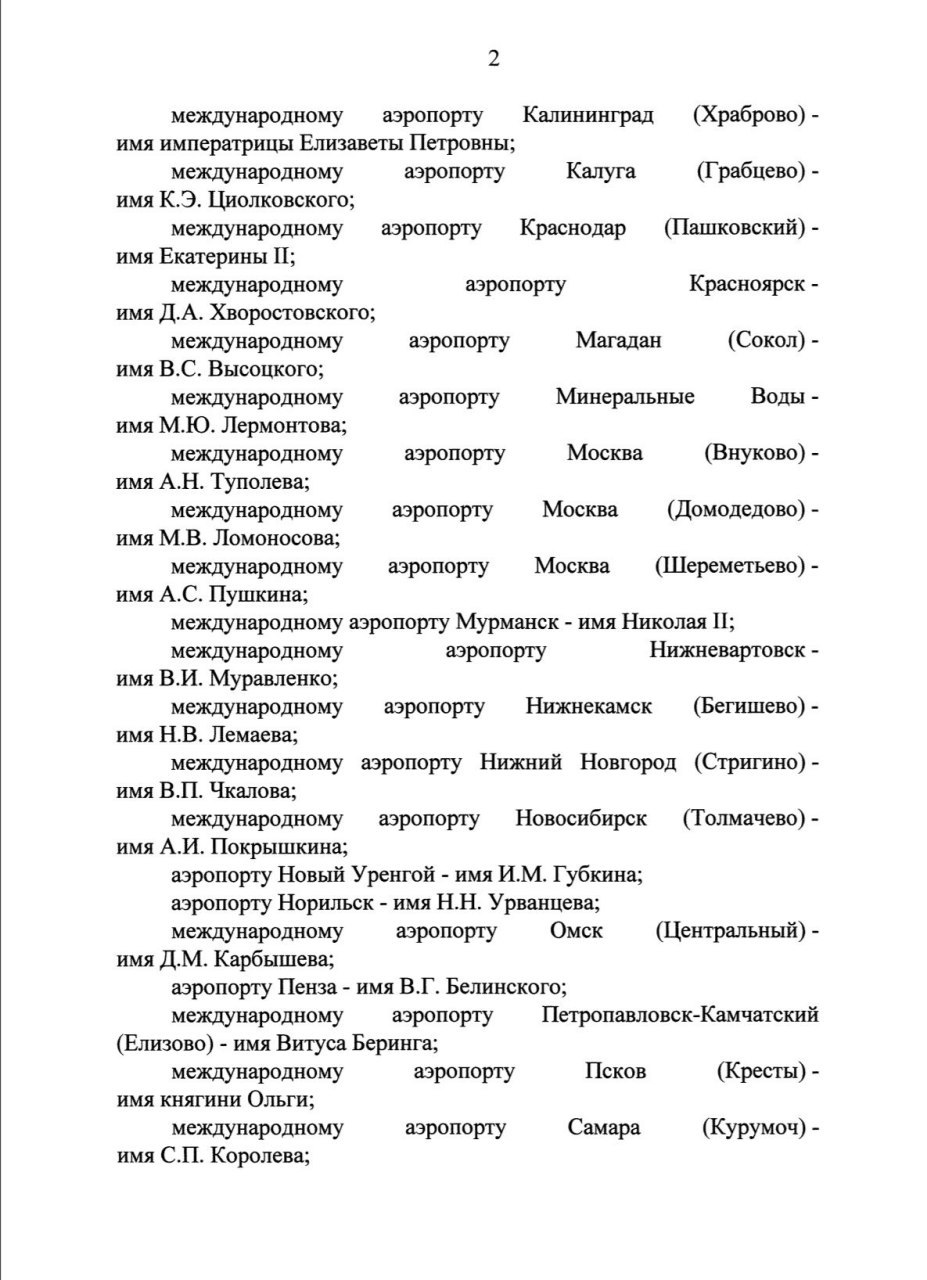

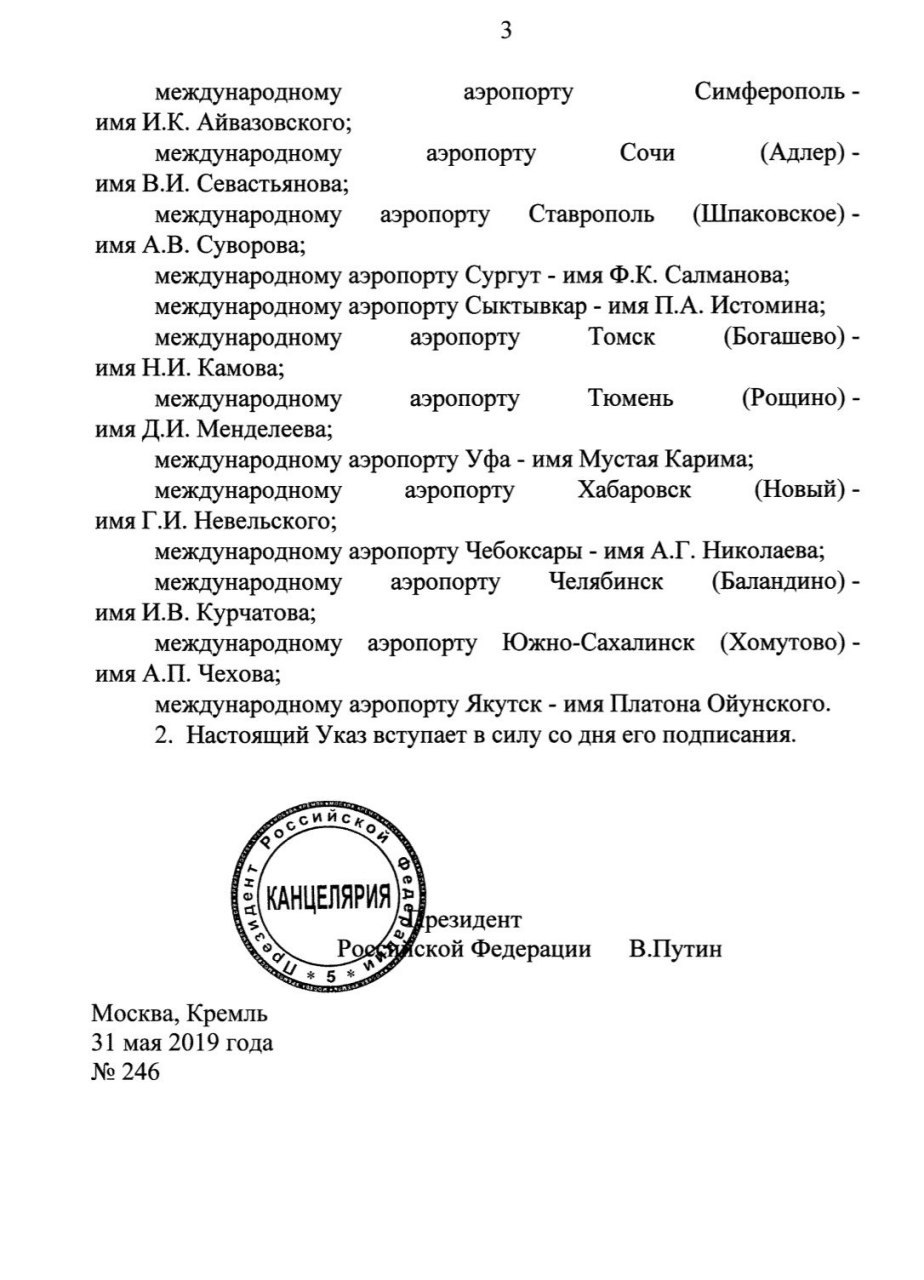

По легенде, когда умирал граф Шереметьев, он завещал назвать в его честь аэропорт.

Родные в недоумении спросили его:

— Какой ещё аэр... аэропорт?

На что Димитрий Николаевич загадочно ответил:

— Оба...

Родные в недоумении спросили его:

— Какой ещё аэр... аэропорт?

На что Димитрий Николаевич загадочно ответил:

— Оба...

2019 June 01

Словивший больше всех лайков коммент в уютном сообществе спецов по Корее на фб.