🐙

Size: a a a

2020 August 13

Ой, да, точно, именно он

КМ

чтобы модель понимала разные формы слов, тебе нужны вектора (или одинаковая лемматизация). в том примере есть как раз fasttext вектора.

встроенные вектора будут в релизе 2.3, можно взять модель https://github.com/buriy/spacy-ru/releases/tag/v2.3_pre1 , там уже есть вектора.

используй spacy.load('ru2_syntagrus') , т.к. они что-то там поменяли в лемматизаторе в v2.3 и надо апдейтить кастомный лемматизатор.

встроенные вектора будут в релизе 2.3, можно взять модель https://github.com/buriy/spacy-ru/releases/tag/v2.3_pre1 , там уже есть вектора.

используй spacy.load('ru2_syntagrus') , т.к. они что-то там поменяли в лемматизаторе в v2.3 и надо апдейтить кастомный лемматизатор.

Привет, наконец руки дошли и у меня возникли проблемы, есть корпус текстов из 33к предложений, если обучаю в spacy пустую модель на 50 итерациях, ошибка постепенно снижается с четырехзначных значений, до двухзначных, а вот если импользовать твою модель, то ошибка просто запредельная 233к - 237к.

В meta.json указано, что NER пустой у модели, т.е. нет обученных сущностей. А почему такое запредельное значение ошибки? Мб это связано с объемом датасета? Что посоветуете?

Обучаю с помощью этого скрипта

https://spacy.io/usage/training#example-train-ner

В meta.json указано, что NER пустой у модели, т.е. нет обученных сущностей. А почему такое запредельное значение ошибки? Мб это связано с объемом датасета? Что посоветуете?

Обучаю с помощью этого скрипта

https://spacy.io/usage/training#example-train-ner

YB

Привет, наконец руки дошли и у меня возникли проблемы, есть корпус текстов из 33к предложений, если обучаю в spacy пустую модель на 50 итерациях, ошибка постепенно снижается с четырехзначных значений, до двухзначных, а вот если импользовать твою модель, то ошибка просто запредельная 233к - 237к.

В meta.json указано, что NER пустой у модели, т.е. нет обученных сущностей. А почему такое запредельное значение ошибки? Мб это связано с объемом датасета? Что посоветуете?

Обучаю с помощью этого скрипта

https://spacy.io/usage/training#example-train-ner

В meta.json указано, что NER пустой у модели, т.е. нет обученных сущностей. А почему такое запредельное значение ошибки? Мб это связано с объемом датасета? Что посоветуете?

Обучаю с помощью этого скрипта

https://spacy.io/usage/training#example-train-ner

ну, как минимум, удалить модель NER (из meta.json, если там есть слово ner в списке моделей, и каталог заодно удалить), и пообучать ещё. а во-вторых, смотреть параметры обучения.

Если не подходит модель с векторами, то пробовать без векторов, да. Или взять модель ner из 2.1 за основу, с теми векторами, возможно, оно больше подойдёт. Кто-то тут успешно обучал вроде бы.

Если не подходит модель с векторами, то пробовать без векторов, да. Или взять модель ner из 2.1 за основу, с теми векторами, возможно, оно больше подойдёт. Кто-то тут успешно обучал вроде бы.

КМ

ну, как минимум, удалить модель NER (из meta.json, если там есть слово ner в списке моделей, и каталог заодно удалить), и пообучать ещё. а во-вторых, смотреть параметры обучения.

Если не подходит модель с векторами, то пробовать без векторов, да. Или взять модель ner из 2.1 за основу, с теми векторами, возможно, оно больше подойдёт. Кто-то тут успешно обучал вроде бы.

Если не подходит модель с векторами, то пробовать без векторов, да. Или взять модель ner из 2.1 за основу, с теми векторами, возможно, оно больше подойдёт. Кто-то тут успешно обучал вроде бы.

спасибо) в мете пустой список)

хотел еще спросить, почему в мастер ветке spacy-ru не последняя версия?) и какая там вообще версия?

хотел еще спросить, почему в мастер ветке spacy-ru не последняя версия?) и какая там вообще версия?

YB

спасибо) в мете пустой список)

хотел еще спросить, почему в мастер ветке spacy-ru не последняя версия?) и какая там вообще версия?

хотел еще спросить, почему в мастер ветке spacy-ru не последняя версия?) и какая там вообще версия?

потому что в августе тестирую 2.3 (там есть некоторые небольшие недоработки) и доделываю туда NER.

https://github.com/buriy/spacy-ru/tree/v2.3 вот ветка 2.3 .

а ветка для 2.1 , которая в мастере — стабильная и проверенная в бою.

https://github.com/buriy/spacy-ru/tree/v2.3 вот ветка 2.3 .

а ветка для 2.1 , которая в мастере — стабильная и проверенная в бою.

КМ

потому что в августе тестирую 2.3 (там есть некоторые небольшие недоработки) и доделываю туда NER.

https://github.com/buriy/spacy-ru/tree/v2.3 вот ветка 2.3 .

а ветка для 2.1 , которая в мастере — стабильная и проверенная в бою.

https://github.com/buriy/spacy-ru/tree/v2.3 вот ветка 2.3 .

а ветка для 2.1 , которая в мастере — стабильная и проверенная в бою.

понял, еще раз спасибо)

A

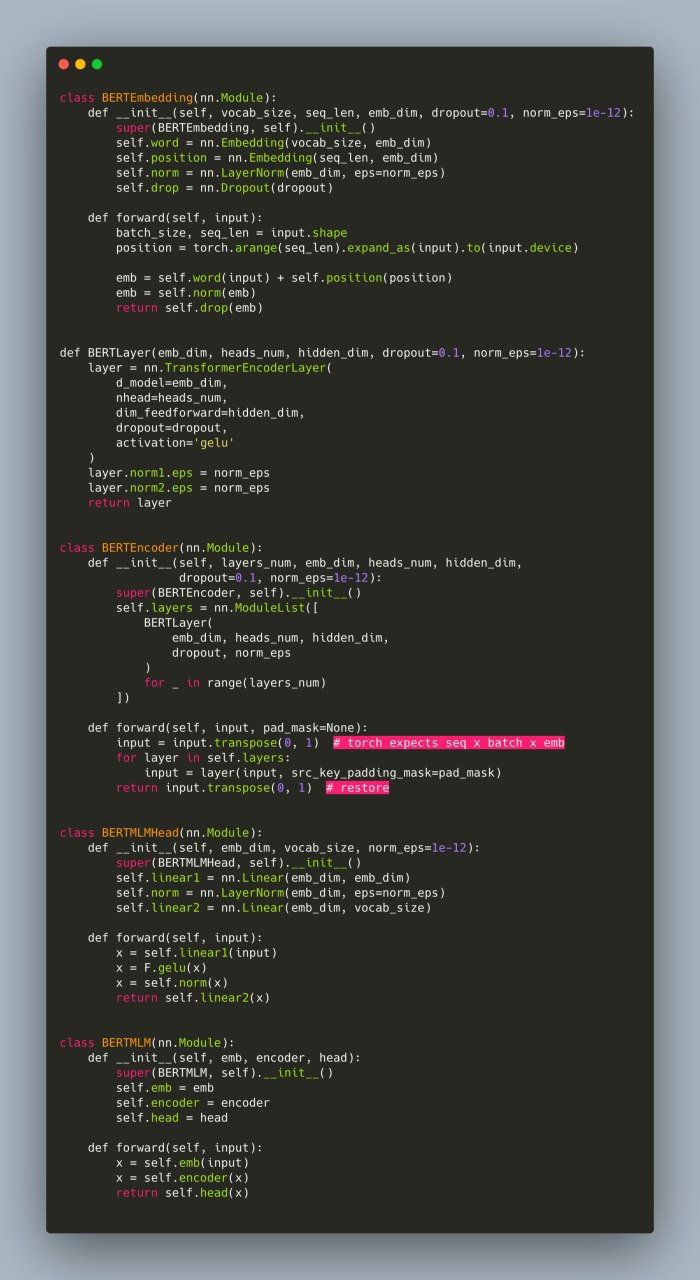

Коллеги, тут кидали картинку. А что это за редактор?

D•

Это не редактор, это сайт. Туда кидаешь код он тебе раскрашивает

DK

Это не редактор, это сайт. Туда кидаешь код он тебе раскрашивает

Text sublime же, не?

D•

Text sublime же, не?

Нет.

ck

очень на sublime похож. Для красивых скриншотов снипетов еще такое есть https://marketplace.visualstudio.com/items?itemName=pnp.polacode

ck

похож на редактор, да не он - печаталка снипетов это

MT

Крайне похож на sublime text

D•

Может быть потому что там цветовая краска monokai используется?

MT

Поэтому и говорю, что похож :)

RS

Привет!

Подскажите, пожалуйста, ресурсы/статьи по генерации альтернативных ответов к вопросам.

Предположим, нам дан отрывок текста, вопрос и правильный ответ на него (например, вопрос "Что построили в Париже в 1889 году?", ответ "Эйфелева башня"). Задача сгенерировать заведомо неправильные варианты ответов (например, Лувр, Версаль и т.п.)

Подскажите, пожалуйста, ресурсы/статьи по генерации альтернативных ответов к вопросам.

Предположим, нам дан отрывок текста, вопрос и правильный ответ на него (например, вопрос "Что построили в Париже в 1889 году?", ответ "Эйфелева башня"). Задача сгенерировать заведомо неправильные варианты ответов (например, Лувр, Версаль и т.п.)

FF

Привет!

Подскажите, пожалуйста, ресурсы/статьи по генерации альтернативных ответов к вопросам.

Предположим, нам дан отрывок текста, вопрос и правильный ответ на него (например, вопрос "Что построили в Париже в 1889 году?", ответ "Эйфелева башня"). Задача сгенерировать заведомо неправильные варианты ответов (например, Лувр, Версаль и т.п.)

Подскажите, пожалуйста, ресурсы/статьи по генерации альтернативных ответов к вопросам.

Предположим, нам дан отрывок текста, вопрос и правильный ответ на него (например, вопрос "Что построили в Париже в 1889 году?", ответ "Эйфелева башня"). Задача сгенерировать заведомо неправильные варианты ответов (например, Лувр, Версаль и т.п.)

Можно попробовать от ответа поискать близкие слова в w2v

FF

Хотя адекватность может хромать