AL

https://natasha.github.io/nerus

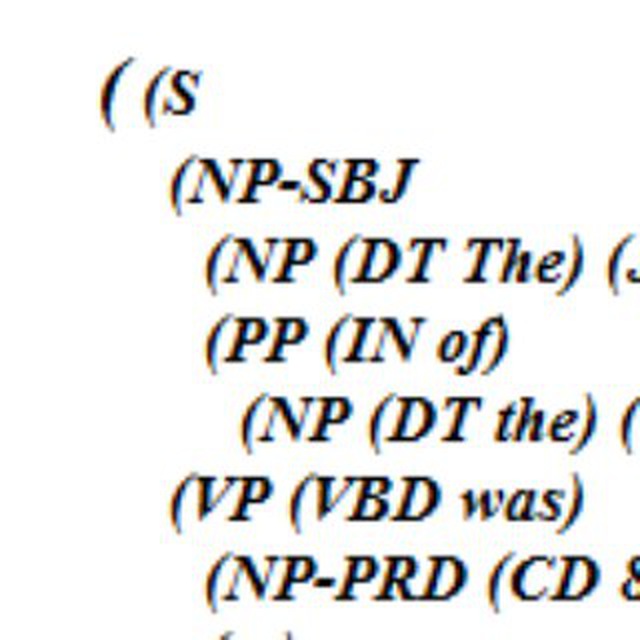

Месяц назад был пост про компактный NER из проекта Natasha https://natasha.github.io/ner. Получилось сжать модель в 75 раз, проиграть 1 процентный пункт SOTA BERT от DeepPavlov. Главный ингредиент там огромный синтетический датасет. Компактные модели начинают нормально работать только если обучить их на сотнях тысяч примеров. Мы публикуем архив в репозитории Nerus https://github.com/natasha/nerus, чтобы другие исследователи могли повторить и улучшить наше решении. Про качество разметки и Python-интерфейс в https://natasha.github.io/nerus.

В https://github.com/buriy/spacy-ru на Nerus обучают качественные русские модели для SpaCy, вроде бы получается даже лучше чем в Natasha.