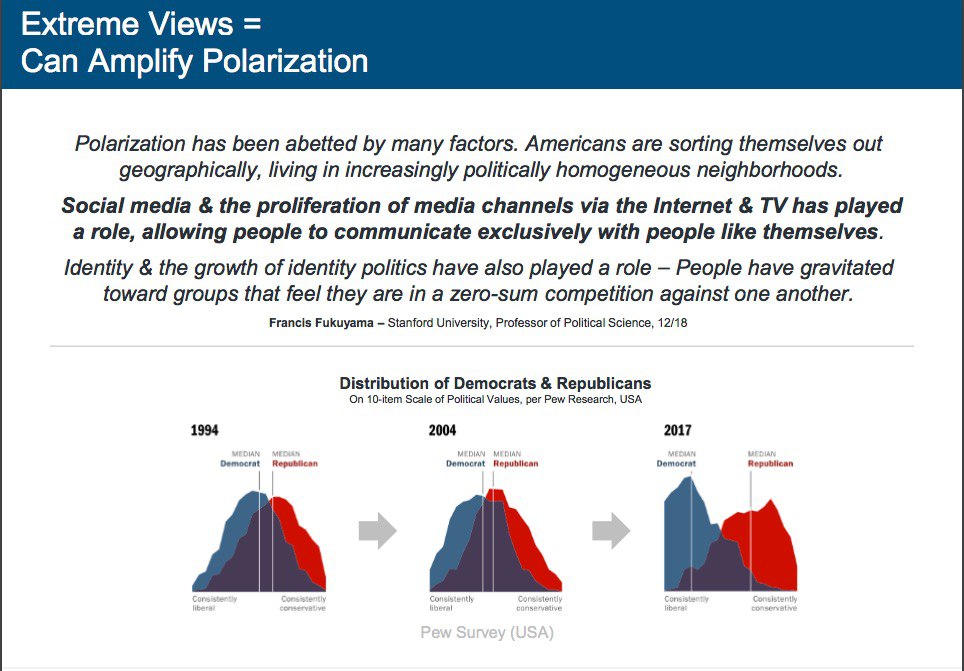

70% времени, которое мы проводим на Ютюбе – результат работы рекомендательных алгоритмов. Алгоритмы устроены так, чтобы пользователь проводил как можно больше времени на сайте (а Ютюб получал больше денег от рекламодателей).

Самообучаемый ИИ, на котором основаны алгоритмы, быстро выяснил: пользователи в среднем дольше смотрят видео, если его контент более радикален, чем у предыдущего просмотренного ролика. Поэтому алгоритмы стали советовать пользователям всё более радикальные ролики. Например, после выступления Трампа вам могут порекомендовать альт-райтовский ролик, а потом – ролики об отрицании Холокоста и превосходстве белой расы.

СМИ неоднократно писали, что за последние годы алгоритмы радикализовали много людей, особенно малообразованных (прошлогодний мастрид об этом:

t.me/mustreads/1475). Стоит отметить, что такая радикализация работает и в левую, и в правую сторону.

В английском есть специальный термин "red pilling" (в честь красной таблетки Морфеуса). Ред-пиллингом называют превращение либералов в консерваторов. Свежий мастрид рассматривает историю Калеба Кейна – парня, который попал в «кротовую нору» алгоритмов и за пару лет просмотра правых ютюберов, рекомендованных алгоритмами, превратился в достаточно радикального альт-райта. А потом снова изменил взгляды, случайно (опять же благодаря алгоритмам) начав смотреть ролики леволиберальных ютюберов. Сейчас он говорит, что ему «промыли мозги» и он чудом выкарабкался, завёл влог левой направленности и спорит в нём с альт-райтами.

Герой материала предоставил журналисту NY Times историю всех просмотренных им видео и своих поисковых запросов на Ютюбе за несколько последних лет. Выдержки из неё есть в материале, можете сами проследить, как эволюционировали взгляды Кейна. Почитайте, захватывает:

nytimes.com/interactive/2019/06/08/technology/youtube-radical.htmlВ последнее время Ютюб начал борьбу с радикализацией пользователей и с экстремизмом на своей площадке. Но возникла другая проблема: на прошлой неделе сервис по спорным основаниям забанил или демонетизировал (лишил доходов от рекламы) многие каналы со спорным контентом. Причём не только откровенных радикалов и неонацистов, но и умеренных альт-райтов, которые зачастую делают интересный и достойный контент. Например, Стивена Краудера, автора консервативно-комедийного канала с 4 миллионами подписчиков, демонетизировали за достаточно невинные шутки над журналистом Vox (самая жёсткая из них была в том, что Краудер назвал журналиста «жеманным геем»).

Конечно, такие жёсткие меры со стороны Ютюба – перегиб, и они справедливо вызвали массовое возмущение у онлайн-сообщества. Я не согласен с Краудером по большинству вопросов, но, как говорится, сначала они пришли за альт-райтами, и я молчал, а потом некому было заступиться, когда пришли за мной.

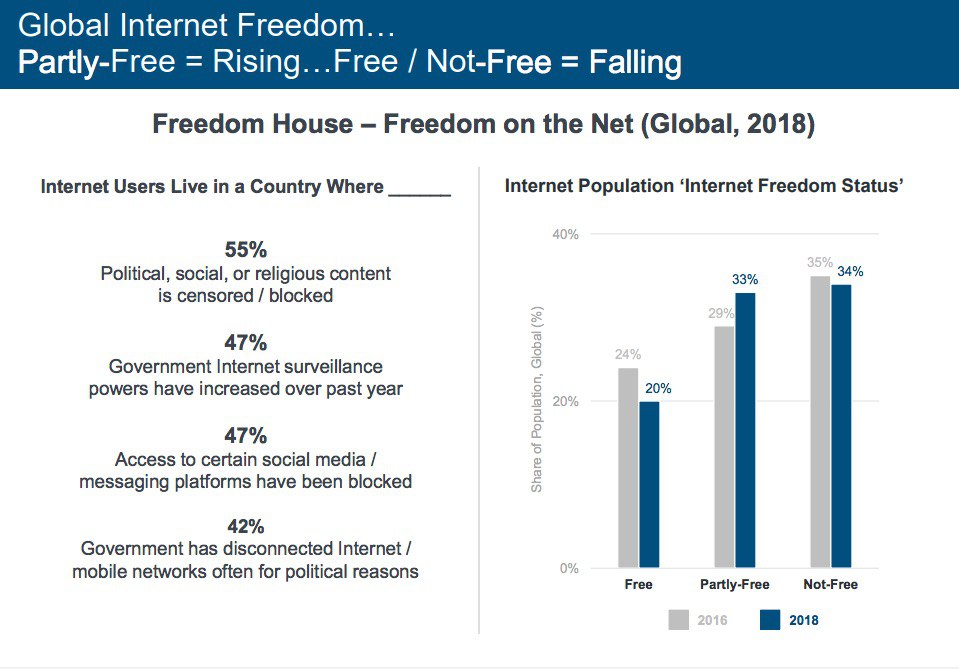

При этом проблема радикализации молодёжи на ютюбе действительно важна, и нужно что-то с ней делать. Но банхаммер – не лучшая идея. Возможно, нужно вводить механизмы общественного контроля и требования к устройству алгоритмов, но чёткого рецепта у меня пока нет. Многие выступают за госконтроль, но это может быть ещё хуже и опаснее (даже если речь идёт о демократических странах).

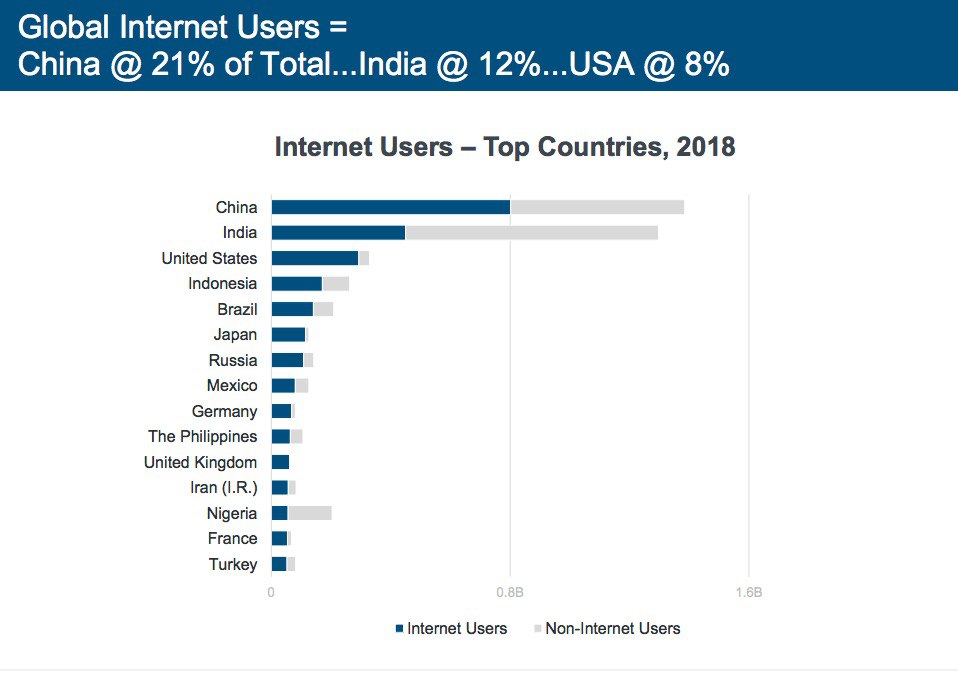

Думаю, со временем дискуссия будет только нарастать, а проблемы – обостряться. Похожие претензии есть к Фейсбуку и радикализации им своих пользователей. Советую маствотч, в котором Юваль Харари (автор бестселлеров Sapiens и Homo Deus) уничтожает в споре Цукерберга, напирая на угрозу для мира от ИТ-гигантов вроде Фейсбука и Гугла:

t.me/mustwatch/659.

PS. В тексте есть комментарии Тристана Харриса, который раньше занимал в Google должность Design Ethicist. Потом Харрис ушёл из Гугла и основал свою НКО – «Центр гуманных технологий», который борется за этичность работы ИТ-гигантов. Советую маствотч, в котором он беседует с Харари:

t.me/mustwatch/600.

#тренд_мастрид