AW

Size: a a a

2021 January 30

Коллеги, всем добрый вечер! А что сейчас чаще всего спрашивают на собесах по нлп? Так сказать какой джентельменакий минимум?

Классика мл, представления текста +/- отличия, иногда просят в общих чертах прояснить, сетки- построение, тюнинг, гиперметры.

AE

Ну это кажется в целом про дип лернинг и нейронки. А именно что касается нлп? Кроме вот представления текста. Кажется могут за берт спросить это же по сути сота, наверное еще чуть более простые модели w2v / d2v. Спрашивают ли регулярки?

AW

Ну это кажется в целом про дип лернинг и нейронки. А именно что касается нлп? Кроме вот представления текста. Кажется могут за берт спросить это же по сути сота, наверное еще чуть более простые модели w2v / d2v. Спрашивают ли регулярки?

Ну а nlp это не dl и nn?)))

Могут про что угодно спросить. Я в одном месте большую часть про sql и паралельностью разговаривал. Зависит от конторы.

Могут про что угодно спросить. Я в одном месте большую часть про sql и паралельностью разговаривал. Зависит от конторы.

DK

Ну а nlp это не dl и nn?)))

Могут про что угодно спросить. Я в одном месте большую часть про sql и паралельностью разговаривал. Зависит от конторы.

Могут про что угодно спросить. Я в одном месте большую часть про sql и паралельностью разговаривал. Зависит от конторы.

Не только

AE

Ну да, но просто мб какая то своя специфика должна. Как напртмер аугментации текстов это совсем иное

AE

Регулярки это чистое нлп

DD

Коллеги, всем добрый вечер! А что сейчас чаще всего спрашивают на собесах по нлп? Так сказать какой джентельменакий минимум?

Я сам не очень много собесился и не очень много собесил, но есть ощущение, что общепризнанного в индустрии "джентльменского минимума" пока не сложилось.

Где-то будут просить жёсткие классические алгоритмы (ведь в том же условном Яндексе, знаменитом своими алгоритмическими задачами, многие из них вполне себе про тексты).

Где-то будут спрашивать про SOTA нейронки.

Где-то будут спрашивать про разные NLPшные задачи, способы их формализации и методы оценки качества: перевод, NER, морфологический анализ, суммаризация, и т.п.

Где-то вообще не будут спрашивать что-то конкретное, а просто интересоваться твоим опытом.

Где-то будут просить жёсткие классические алгоритмы (ведь в том же условном Яндексе, знаменитом своими алгоритмическими задачами, многие из них вполне себе про тексты).

Где-то будут спрашивать про SOTA нейронки.

Где-то будут спрашивать про разные NLPшные задачи, способы их формализации и методы оценки качества: перевод, NER, морфологический анализ, суммаризация, и т.п.

Где-то вообще не будут спрашивать что-то конкретное, а просто интересоваться твоим опытом.

c

Cпрашивали алгоритмы c лайв-коддингом, классический ML, DL. По NLP конкретно говорили про LSTM/GRU, attention

AW

care1e55

Cпрашивали алгоритмы c лайв-коддингом, классический ML, DL. По NLP конкретно говорили про LSTM/GRU, attention

Лайв кодинг lstm?

c

Не, на лайв секции былы задачки с нампай и колекциями. Перед этим было тестовое на алгоритмы. Но могут и попросить что-нибуть с литкода уровня medium. Кажется сейчас это стандартно просят

c

Лайв кодинг LSTM: from torch.nn import LSTM

2021 January 31

AK

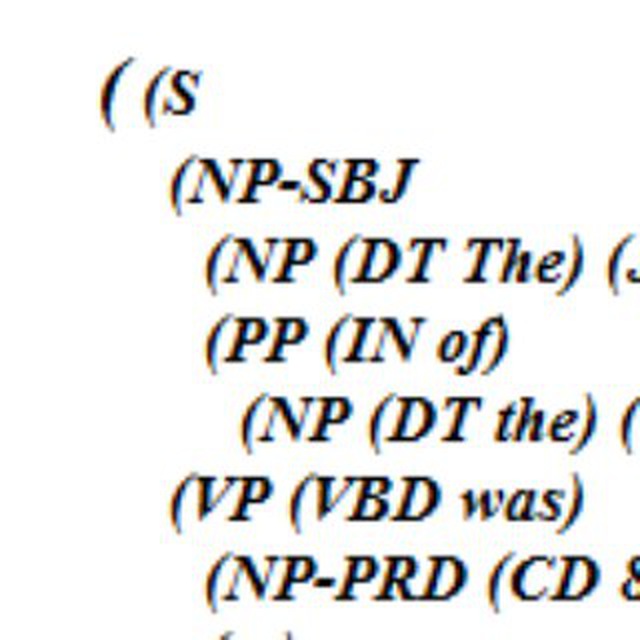

Новый CS224N, автор BERT рассказывает про BERT и компанию https://youtu.be/knTc-NQSjKA

2021 February 01

AL

Какие есть подходы/решения по выделению статистистически значимых слов, их сочетаний из списка фраз?

Положим, есть несколько десятков тысяч запросов пользователей в вольной форме. Нужно выделить части, наиболее часто встречающиеся, чтобы понять, что вообще в этом наборе люди чаще всего хотят)

Положим, есть несколько десятков тысяч запросов пользователей в вольной форме. Нужно выделить части, наиболее часто встречающиеся, чтобы понять, что вообще в этом наборе люди чаще всего хотят)

У меня есть в общем доступе такая штука https://manystat.ru/tools/seo_group_wordstat.html - поиграйтесь с ним :) насчет 10к не уверен - там обычный хостинг... попробуйте пару тысяч вставить. Фраза и частота, через tab. В виде дерева, на мой взгляд, это прикольно анализировать :)

AL

Кстати, а есть какой-нибудь хороший сборник онлайн-инструментов для работы с текстами? Вот тот же топ n-грамм построить, нормализовать формы и т.п.?

T

У меня есть в общем доступе такая штука https://manystat.ru/tools/seo_group_wordstat.html - поиграйтесь с ним :) насчет 10к не уверен - там обычный хостинг... попробуйте пару тысяч вставить. Фраза и частота, через tab. В виде дерева, на мой взгляд, это прикольно анализировать :)

Спасибо

BS

Кто разбирается, подскажите, почему в свич трансформере не стакают слой с экспертами?

BS

Просто не дошли руки ещё или есть какой-то подвох?

SМ

Кто разбирается, подскажите, почему в свич трансформере не стакают слой с экспертами?

Там же в итоге они одного только выбирают жеж?

SМ

Лучшего

BS

Да

Так над этим слоем поставить ещё один такой же

Так над этим слоем поставить ещё один такой же