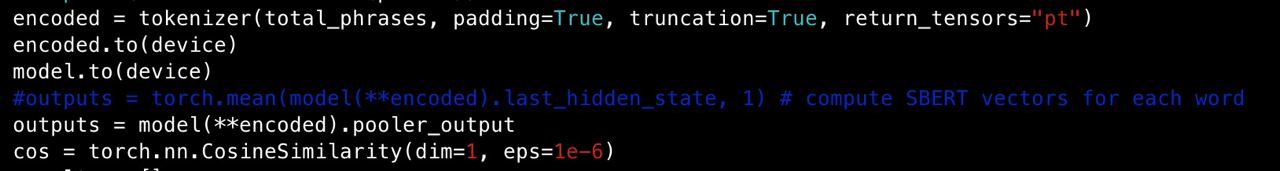

На семинаре по байесовским методам в ML Катя Лобачёва рассказывает про BERT. Традиционный формат для академии: докладчик прочитал кучу статей, отобрал важное, логично пересказал. Трансформер, ELMO, GPT, BERT, что там происходит внутри, контекстуальность эмбеддингов, головы атеншена, трюки из RoBERTa, XLNet, ALBERT, ERNIE, ELECTRA.

Не очень глубоко, зато полно и на русском. Интересен взгляд из другой области, балдеют от количества статей вокруг BERT, объёма ресурсов.

https://www.youtube.com/watch?v=JO-RJRCkLvMhttps://www.youtube.com/watch?v=5o8gTP-7xwg