TM

Size: a a a

2020 November 16

огромное спасибо за информирование, будем следить

YB

!pip install "spacy>=2.3"

In [3]: nlp=spacy.load('releases/2.3beta/ru2_nerus_800ks_96')

In [4]: w = nlp('тачка тачку машина транспорт авто средство колымага')

In [8]: for t in w:

...: print(t, t.has_vector, t.is_oov, t.similarity(w[0]))

...:

...:

...:

тачка True False 1.0

тачку True False 1.0

машина True False 0.46673042

транспорт True False 0.2455553

авто True False 0.39078075

средство True False -0.004572388

колымага True False 0.5910443

In [3]: nlp=spacy.load('releases/2.3beta/ru2_nerus_800ks_96')

In [4]: w = nlp('тачка тачку машина транспорт авто средство колымага')

In [8]: for t in w:

...: print(t, t.has_vector, t.is_oov, t.similarity(w[0]))

...:

...:

...:

тачка True False 1.0

тачку True False 1.0

машина True False 0.46673042

транспорт True False 0.2455553

авто True False 0.39078075

средство True False -0.004572388

колымага True False 0.5910443

а вот для слова "автомобиль":

тачка True False 0.4261163

тачку True False 0.4261163

машина True False 0.77885175

транспорт True False 0.45201242

авто True False 0.69870263

средство True False 0.3050452

колымага True False 0.3159924

автомобиль True False 1.0

тачка True False 0.4261163

тачку True False 0.4261163

машина True False 0.77885175

транспорт True False 0.45201242

авто True False 0.69870263

средство True False 0.3050452

колымага True False 0.3159924

автомобиль True False 1.0

YB

огромное спасибо за информирование, будем следить

нет, релиз сам-то есть и выложен, просто к нему нет нормальной инструкции! и не измерено нормально качество NER. остальное всё есть.

TM

а вот для слова "автомобиль":

тачка True False 0.4261163

тачку True False 0.4261163

машина True False 0.77885175

транспорт True False 0.45201242

авто True False 0.69870263

средство True False 0.3050452

колымага True False 0.3159924

автомобиль True False 1.0

тачка True False 0.4261163

тачку True False 0.4261163

машина True False 0.77885175

транспорт True False 0.45201242

авто True False 0.69870263

средство True False 0.3050452

колымага True False 0.3159924

автомобиль True False 1.0

это тоже dev ветка или релизная?

TM

нет, релиз сам-то есть и выложен, просто к нему нет нормальной инструкции! и не измерено нормально качество NER. остальное всё есть.

понял, нашел! попробую с 2.3

YB

это тоже dev ветка или релизная?

просто с обычной spacy загружаешь файл модели, взятой по этой ссыке: https://github.com/buriy/spacy-ru/releases/tag/v2.3_beta

TM

просто с обычной spacy загружаешь файл модели, взятой по этой ссыке: https://github.com/buriy/spacy-ru/releases/tag/v2.3_beta

👍

YB

@yuri_baburov a ru2 на этом корпусе https://github.com/snakers4/open_stt/ обучен ?

Нет конечно. А чему там учиться?

TM

Нет конечно. А чему там учиться?

Действительно , текста то нет . Не увидел

YB

Нет конечно. А чему там учиться?

Вектора учились на худлите (+ дополнения из pymorphy), так что какие-то пересечения про текстам с подкорпусом buriy_audiobook могут быть. Но тестовый корпус намного крупнее, чем текста в аудиокорпусе.

2020 November 17

NM

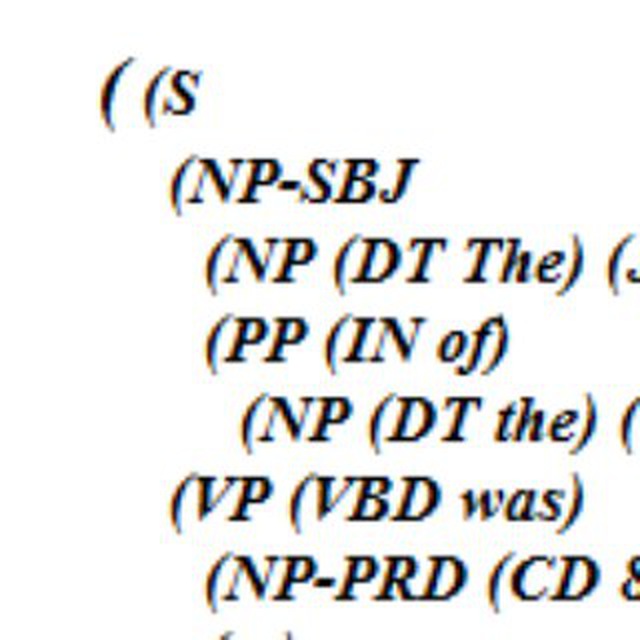

Примерно каждый первый, кто занимался вычислительной лингвистикой, делал выявление поименованных сущностей, например, адресов или имен, из неструктурированного текста. Но задача структурирования текста намного обширнее и сложнее: возникают вопросы о связях поименованных сущностей и т.д., и т.п.

Несмотря на то, что выявления поименованных сущностей я так или иначе касался (с перерывами) лет пятнадцать, для меня недавно открытием явилось наличие подходов, связанных с системами переходов. Похоже, они позволяют описать многие задачи структурного предсказания в рамках единого фреймворка.

На очередном научно-техническом вебинаре НТР и HITS ТГУ (сегодня, 17 ноября, в 15 часов по Москве и 19 по Томску) Егор Грибков обсудит структурное предсказание в обработке естественного языка. Если честно, самому очень интересно.

Регистрация по https://us02web.zoom.us/webinar/register/1515989556145/WN_TRftoSBaR-KGXYQW6wlxTg

Несмотря на то, что выявления поименованных сущностей я так или иначе касался (с перерывами) лет пятнадцать, для меня недавно открытием явилось наличие подходов, связанных с системами переходов. Похоже, они позволяют описать многие задачи структурного предсказания в рамках единого фреймворка.

На очередном научно-техническом вебинаре НТР и HITS ТГУ (сегодня, 17 ноября, в 15 часов по Москве и 19 по Томску) Егор Грибков обсудит структурное предсказание в обработке естественного языка. Если честно, самому очень интересно.

Регистрация по https://us02web.zoom.us/webinar/register/1515989556145/WN_TRftoSBaR-KGXYQW6wlxTg

AP

Примерно каждый первый, кто занимался вычислительной лингвистикой, делал выявление поименованных сущностей, например, адресов или имен, из неструктурированного текста. Но задача структурирования текста намного обширнее и сложнее: возникают вопросы о связях поименованных сущностей и т.д., и т.п.

Несмотря на то, что выявления поименованных сущностей я так или иначе касался (с перерывами) лет пятнадцать, для меня недавно открытием явилось наличие подходов, связанных с системами переходов. Похоже, они позволяют описать многие задачи структурного предсказания в рамках единого фреймворка.

На очередном научно-техническом вебинаре НТР и HITS ТГУ (сегодня, 17 ноября, в 15 часов по Москве и 19 по Томску) Егор Грибков обсудит структурное предсказание в обработке естественного языка. Если честно, самому очень интересно.

Регистрация по https://us02web.zoom.us/webinar/register/1515989556145/WN_TRftoSBaR-KGXYQW6wlxTg

Несмотря на то, что выявления поименованных сущностей я так или иначе касался (с перерывами) лет пятнадцать, для меня недавно открытием явилось наличие подходов, связанных с системами переходов. Похоже, они позволяют описать многие задачи структурного предсказания в рамках единого фреймворка.

На очередном научно-техническом вебинаре НТР и HITS ТГУ (сегодня, 17 ноября, в 15 часов по Москве и 19 по Томску) Егор Грибков обсудит структурное предсказание в обработке естественного языка. Если честно, самому очень интересно.

Регистрация по https://us02web.zoom.us/webinar/register/1515989556145/WN_TRftoSBaR-KGXYQW6wlxTg

Спасибо большое за информацию.

FF

Примерно каждый первый, кто занимался вычислительной лингвистикой, делал выявление поименованных сущностей, например, адресов или имен, из неструктурированного текста. Но задача структурирования текста намного обширнее и сложнее: возникают вопросы о связях поименованных сущностей и т.д., и т.п.

Несмотря на то, что выявления поименованных сущностей я так или иначе касался (с перерывами) лет пятнадцать, для меня недавно открытием явилось наличие подходов, связанных с системами переходов. Похоже, они позволяют описать многие задачи структурного предсказания в рамках единого фреймворка.

На очередном научно-техническом вебинаре НТР и HITS ТГУ (сегодня, 17 ноября, в 15 часов по Москве и 19 по Томску) Егор Грибков обсудит структурное предсказание в обработке естественного языка. Если честно, самому очень интересно.

Регистрация по https://us02web.zoom.us/webinar/register/1515989556145/WN_TRftoSBaR-KGXYQW6wlxTg

Несмотря на то, что выявления поименованных сущностей я так или иначе касался (с перерывами) лет пятнадцать, для меня недавно открытием явилось наличие подходов, связанных с системами переходов. Похоже, они позволяют описать многие задачи структурного предсказания в рамках единого фреймворка.

На очередном научно-техническом вебинаре НТР и HITS ТГУ (сегодня, 17 ноября, в 15 часов по Москве и 19 по Томску) Егор Грибков обсудит структурное предсказание в обработке естественного языка. Если честно, самому очень интересно.

Регистрация по https://us02web.zoom.us/webinar/register/1515989556145/WN_TRftoSBaR-KGXYQW6wlxTg

Будет доступна запись?

SZ

Всем привет!

Ищу того, с кем можно было бы проконсультироваться по NLG. Напишите мне, пожалуйста, в лс, если обладаете подобной экспертизой. Спасибо!

Ищу того, с кем можно было бы проконсультироваться по NLG. Напишите мне, пожалуйста, в лс, если обладаете подобной экспертизой. Спасибо!

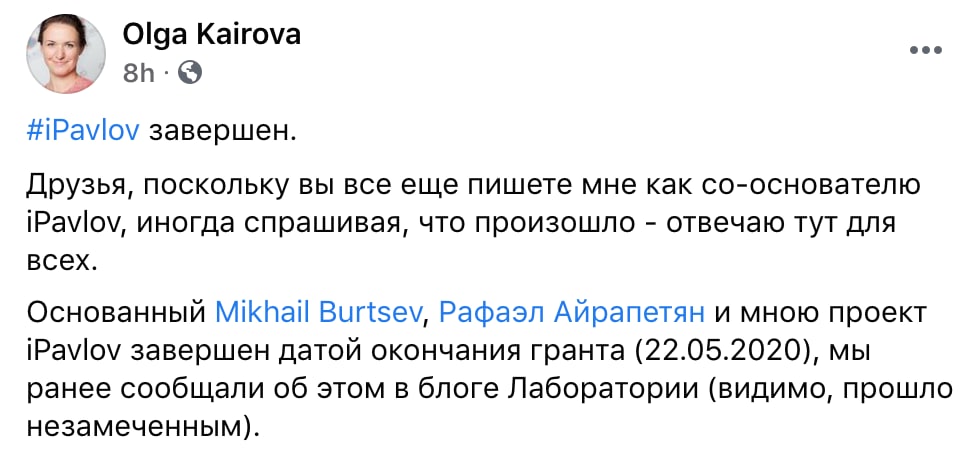

AK

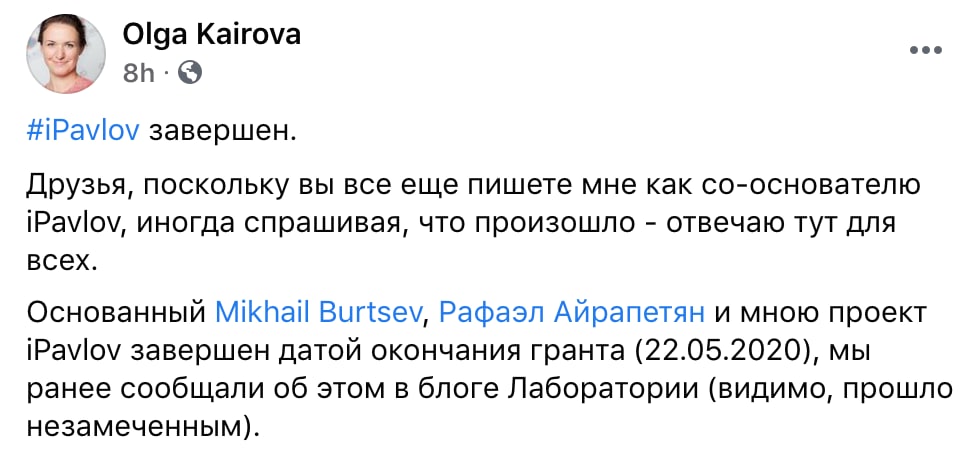

https://www.facebook.com/olga.kairova/posts/10157719960593034

"Но незадолго до завершения гранта наш курирующий проректор в МФТИ Сергей Гаричев решил взять в свои руки коммерциализацию проекта и настоял на передаче бренда iPavlov, SaaS и всех наших коммерческих активов назначенному им СЕО Лорану Акопяну, с запретом команде оригинального проекта iPavlov заниматься его коммерциализацией"

Кто понял что там написано? Что это означает для библиотеки DeepPavlov? Будет продолжаться research и opensource для русского языка

"Но незадолго до завершения гранта наш курирующий проректор в МФТИ Сергей Гаричев решил взять в свои руки коммерциализацию проекта и настоял на передаче бренда iPavlov, SaaS и всех наших коммерческих активов назначенному им СЕО Лорану Акопяну, с запретом команде оригинального проекта iPavlov заниматься его коммерциализацией"

Кто понял что там написано? Что это означает для библиотеки DeepPavlov? Будет продолжаться research и opensource для русского языка

SP

https://www.facebook.com/olga.kairova/posts/10157719960593034

"Но незадолго до завершения гранта наш курирующий проректор в МФТИ Сергей Гаричев решил взять в свои руки коммерциализацию проекта и настоял на передаче бренда iPavlov, SaaS и всех наших коммерческих активов назначенному им СЕО Лорану Акопяну, с запретом команде оригинального проекта iPavlov заниматься его коммерциализацией"

Кто понял что там написано? Что это означает для библиотеки DeepPavlov? Будет продолжаться research и opensource для русского языка

"Но незадолго до завершения гранта наш курирующий проректор в МФТИ Сергей Гаричев решил взять в свои руки коммерциализацию проекта и настоял на передаче бренда iPavlov, SaaS и всех наших коммерческих активов назначенному им СЕО Лорану Акопяну, с запретом команде оригинального проекта iPavlov заниматься его коммерциализацией"

Кто понял что там написано? Что это означает для библиотеки DeepPavlov? Будет продолжаться research и opensource для русского языка

Не очень понятно, кто теперь правообладатель и какова судьба всего софта с позиции копирайта.

DK

вроде как диппавлов и айпавлов теперь отдельно, и диппавлов сам по себе

V

Так как по гранту то возможно код до 22.05 свободен, дальше в него комитить не будут авторы, только сообщество. Дальше будет форк в свой коммерческий репозиторий и развитие в нем.

V

Я так понял, и конечный продукт ipavlov уходит в коммерческие руки. Авторы именно продукт не могут форкнуть. А библиотека живёт дальше своей жизнью