Size: a a a

2018 October 08

Российские инженеры разработали виброперчатку для управления роем дронов https://nplus1.ru/news/2018/10/08/drones

Российские инженеры из Сколковского университета выпустили виброперчатку для управления роем дронов при помощи движений рук:

https://hightech.fm/2018/10/08/vibro?io_source=tg

https://hightech.fm/2018/10/08/vibro?io_source=tg

Российский совет по международным делам опубликовал любопытную статью (https://t.me/russiancouncil/1762) о перспективах и угрозах, исходящих от сильного искусственного интеллекта. В двух словах, сильный ИИ — кибер-физическая система, способная решать разнообразные задачи обучения, классификации и распознавания образов без переобучения в различных контекстах. В обработке текстов, например, сильный ИИ смог бы автоматически переводить литературные произведения с английского на русский, находить в них отсылки к культурному контексту и «разумно» отвечать на вопросы о мотивации героев, а потом, после небольшого периода дообучения, проделывать то же самое с текстами на французском.

Очевидно, что создание сильного ИИ до неузнаваемости изменит отношение человека и общества к компьютерным системам. В статье Антона Колонина описываются вызовы на этом пути, головокружительные перспективы и потенциальные риски новых технологий. Выделим, на наш взгляд, ключевые предложения по снижению рисков, связанного с созданием и (в перспективе) широкой доступностью соответствующих технологий:

1. Международный запрет создания «автономных систем смертоносных вооружений» (LAWS).

2. Государственная поддержка работ в области ИИ и, в особенности, работ по решению задачи целеполагания и контроля за ИИ.

3. Расширение доступа к технологиям ИИ.

4. Международно-правовое регламентирование открытости алгоритмов ИИ, в первую очередь, чтобы сделать возможным контроль за обработкой данных и адекватный функциональный аудит принятия решений на основе машинного обучения.

В целом Ватфор готов сразу подписаться под многими из этих пунктов, но отдельные аспекты требуют более широкой и разносторонней дискуссии. К пункту 4 можно добавить, что нечто подобное уже происходит при разработке автономных автомобилей: так, существуют наработки по стандартизации функционального аудита автомобильных автопилотов. Судя по готовности компаний вроде DeepMind предоставить широкой публике тренировочные данные и готовые модели распознавания, третий пункт на данном этапе проблемой не является. Что же касается государственной поддержки, то, видимо речь идёт о грантах исследовательским группам. Это в целом благое пожелание зачастую ограничено бюджетами и длинными циклами планирования грантов, поэтому этот пункт можно дополнить пожеланием к частным компаниям активнее привлекать сотрудников исследовательских организаций к своей деятельности в виде частных грантов на научно-исследовательские работы, а к университетам — активно сотрудничать с потенциальными коммерческими партнёрами.

Но наиболее спорным можно считать первый пункт. В первую очередь, есть все основания полагать, что гонка вооружений в сфере автономных систем началась (или не останавливалась, в зависимости от перспективы). Во вторую очередь, в международно-правовых понятиях очень сложно отразить понятие автономности: если понимать под автономными системами всё, что само движется к цели после запуска, то под это понятие подпадут баллистические ракеты и самонаводящиеся снаряды, а если понимать всё, что срабатывает без целеуказания, то можно сделать вид, что ничего такого нет, целеуказание-то всегда присутствует, пусть даже в форме «куда-то туда, в первую попавшуюся цель». Если же рассмотреть только этический аргумент, то можно возразить, что запретом на разработки отдаётся преимущество возможным государственным и, тем более, негосударственным нарушителям запрета, которые не будут связаны этическими и легальными нормами. Впрочем, насколько реально создать «на коленке» настоящую боевую систему — вопрос отдельный, и он сложнее, чем кажется.

https://spectrum.ieee.org/transportation/self-driving/creating-driving-tests-for-selfdriving-cars

Очевидно, что создание сильного ИИ до неузнаваемости изменит отношение человека и общества к компьютерным системам. В статье Антона Колонина описываются вызовы на этом пути, головокружительные перспективы и потенциальные риски новых технологий. Выделим, на наш взгляд, ключевые предложения по снижению рисков, связанного с созданием и (в перспективе) широкой доступностью соответствующих технологий:

1. Международный запрет создания «автономных систем смертоносных вооружений» (LAWS).

2. Государственная поддержка работ в области ИИ и, в особенности, работ по решению задачи целеполагания и контроля за ИИ.

3. Расширение доступа к технологиям ИИ.

4. Международно-правовое регламентирование открытости алгоритмов ИИ, в первую очередь, чтобы сделать возможным контроль за обработкой данных и адекватный функциональный аудит принятия решений на основе машинного обучения.

В целом Ватфор готов сразу подписаться под многими из этих пунктов, но отдельные аспекты требуют более широкой и разносторонней дискуссии. К пункту 4 можно добавить, что нечто подобное уже происходит при разработке автономных автомобилей: так, существуют наработки по стандартизации функционального аудита автомобильных автопилотов. Судя по готовности компаний вроде DeepMind предоставить широкой публике тренировочные данные и готовые модели распознавания, третий пункт на данном этапе проблемой не является. Что же касается государственной поддержки, то, видимо речь идёт о грантах исследовательским группам. Это в целом благое пожелание зачастую ограничено бюджетами и длинными циклами планирования грантов, поэтому этот пункт можно дополнить пожеланием к частным компаниям активнее привлекать сотрудников исследовательских организаций к своей деятельности в виде частных грантов на научно-исследовательские работы, а к университетам — активно сотрудничать с потенциальными коммерческими партнёрами.

Но наиболее спорным можно считать первый пункт. В первую очередь, есть все основания полагать, что гонка вооружений в сфере автономных систем началась (или не останавливалась, в зависимости от перспективы). Во вторую очередь, в международно-правовых понятиях очень сложно отразить понятие автономности: если понимать под автономными системами всё, что само движется к цели после запуска, то под это понятие подпадут баллистические ракеты и самонаводящиеся снаряды, а если понимать всё, что срабатывает без целеуказания, то можно сделать вид, что ничего такого нет, целеуказание-то всегда присутствует, пусть даже в форме «куда-то туда, в первую попавшуюся цель». Если же рассмотреть только этический аргумент, то можно возразить, что запретом на разработки отдаётся преимущество возможным государственным и, тем более, негосударственным нарушителям запрета, которые не будут связаны этическими и легальными нормами. Впрочем, насколько реально создать «на коленке» настоящую боевую систему — вопрос отдельный, и он сложнее, чем кажется.

https://spectrum.ieee.org/transportation/self-driving/creating-driving-tests-for-selfdriving-cars

2018 October 09

"Прекрасное" утро. Немного перефразируя недавние слова коллеги, скажу так - ну не было у нас ударных беспилотников и не будет.

https://t.me/new_militarycolumnist/3624

https://t.me/new_militarycolumnist/3624

Российские военные отказались от разработки тяжелого ударного беспилотника https://nplus1.ru/news/2018/10/09/altair

📝Нам пишут, что у проекта Альтаир ⬆️ были большие проблемы с посадкой беспилотника. Это не удивительно, т.к. основным его "разработчиком" являлась питерская группа компаний Транзас. Деятельность данной организации сводится к экспорту через третьи страны продукции двойного назначения и продажи ее под видом отечественных разработок (тепловизоры, видеокамеры и попытки с беспилотником).

@new_militarycolumnist выражает огромную благодарность автору комментария.👍

@new_militarycolumnist выражает огромную благодарность автору комментария.👍

В Казани закрыли разработку самого большого военного беспилотника России

http://prokazan.ru/news/view/128701

http://prokazan.ru/news/view/128701

По данным Airrecognition, Пакистан импортирует 48 китайских беспилотников Wing Loong II. Подробности о возможной сделке отсутствуют.

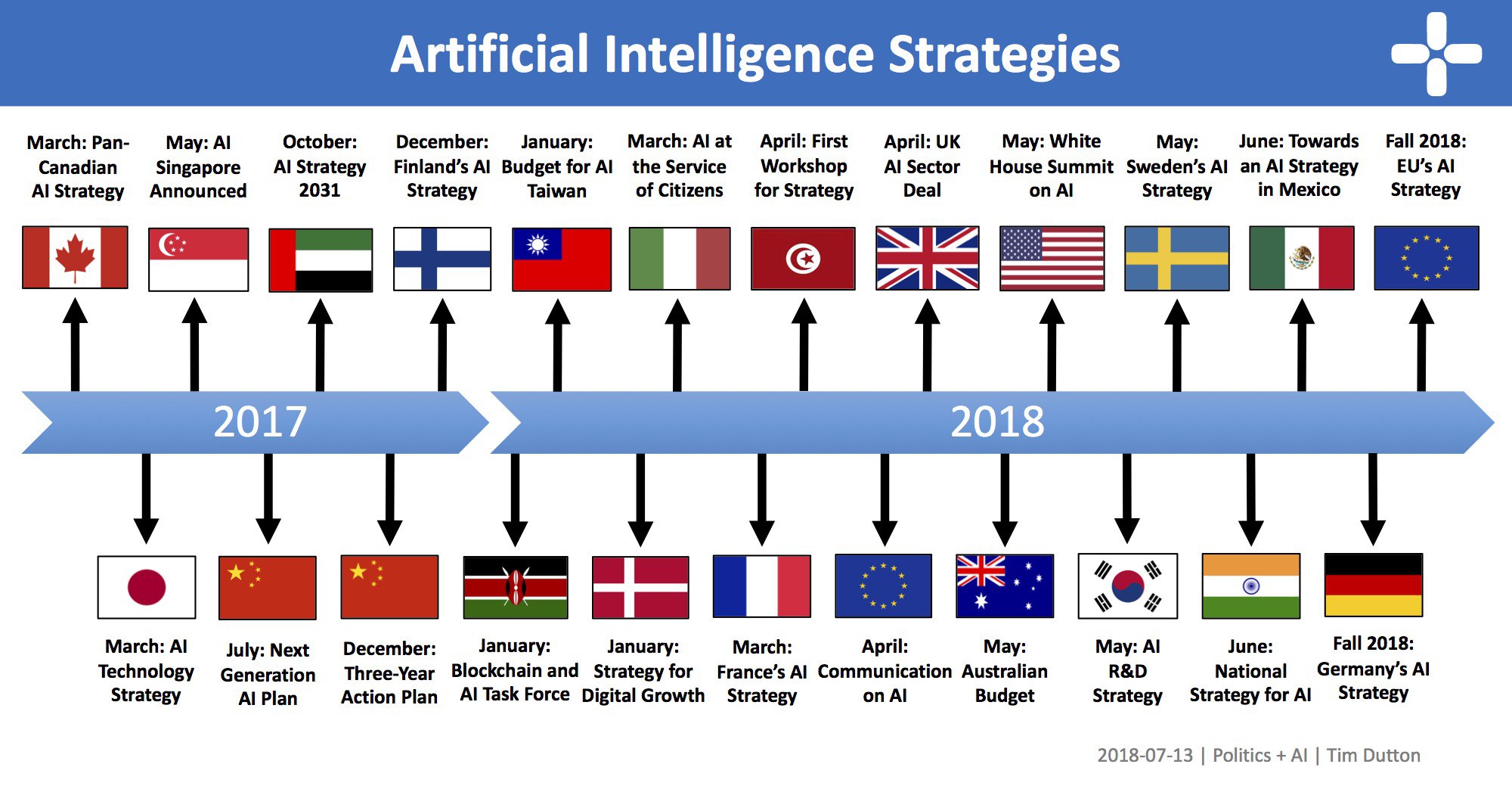

Хороший обзор 23 стратегий по искусственному интеллекту разных стран со ссылками на источники. Помимо США, Китая, Японии, Франции, Великобритании и других стран есть даже два абзаца про Россию, у которой правда еще нет публично объявленной стратегии по ИИ. Любопытно посмотреть на размеры инвестиций, направляемые разными странами на AI. https://medium.com/politics-ai/an-overview-of-national-ai-strategies-2a70ec6edfd

Google отказался участвовать в конкурсе Пентагона

Компания Google отказалась участвовать в конкурсе министерства обороны США, победитель которого создаст систему облачных вычислений за $ 10 млрд.

Google отказался, так как не может гарантировать, что проект будет соответствовать его принципам по этическому использованию своих технологий искусственного интеллекта.

Так, например, принципы компании запрещают ей использовать технологии в вооружениях и проектах, нарушающих права человека.

Также у Google отсутствуют необходимые государственные сертификаты, которые нужны для выполнения работы для Пентагона.

Компания Google отказалась участвовать в конкурсе министерства обороны США, победитель которого создаст систему облачных вычислений за $ 10 млрд.

Google отказался, так как не может гарантировать, что проект будет соответствовать его принципам по этическому использованию своих технологий искусственного интеллекта.

Так, например, принципы компании запрещают ей использовать технологии в вооружениях и проектах, нарушающих права человека.

Также у Google отсутствуют необходимые государственные сертификаты, которые нужны для выполнения работы для Пентагона.

🤖🔥🌐 Технологическое неравенство и раньше сильно влияло на мировую политику и экономику. Самые технологически продвинутые государства становились самыми экономически успешными, они обретали неоспоримое военное превосходство и начинали диктовать свою волю менее развитым странам.

В ХХ в. две мировые войны и немыслимое ускорение научно-технического прогресса еще более усилили это влияние. А с приближением третьей декады ХХI в. лавинообразный рост возможностей машинного обучения заставил говорить о спектре IT-технологий, объединенных метафорическим обозначением «Искусственный интеллект» (#ИИ) как о ключевом факторе экономического, геополитического и военного могущества ближайших десятилетий.

2018 год стал переломным. Ранее основное внимание СМИ, общества и политиков при обсуждении будущих угроз и вызовов развития ИИ было направлено на:

— грядущее вытеснение людей из многих профессий когнитивными агентами ИИ (роботами и программами);

— правовые и этические проблемы автономных ИИ-устройств (например, беспилотных авто);

— проблемы кибербезопасности;

— пугающе манящую перспективу то ли далекого, то ли не очень «бунта машин».

Однако в 2018 г. всё вдруг начало меняться. Перечисленные выше угрозы и вызовы не то чтобы исчезли, но потускнели на фоне происходящего осознания политиками и военными двух глобальных трансформационных трендов, которые можно условно назвать:

— ИИ-национализм

— ИИ-национализация

Сергей Карелов, основатель и Chief Technology Officer компании Witology, автор канала @theworldisnoteasy, в лонгриде для РСМД подробно описал тренды, сформулировал техно-геополитический прогноз

http://russiancouncil.ru/ai

Главными факторами международных отношений станут:

— ИИ-неоколониализм во взаимоотношениях стран-лидеров и стран-аутсайдеров в ИИ-технологиях;

— Гонка ИИ-вооружений между странами-лидерами, определяющая и направляющая дальнейшее развитие ИИ-технологий.

У такой гонки возможны 2 варианта окончания:

A. Вариант «Большая война», в результате которой следующая война будет вестись уже камнями и палками.

B. Вариант «AI Сингулярность» (или «приход лесника»), при котором все ускоряемое гонкой вооружений развитие ИИ-технологий породит «сильный» ИИ, а тот поступит как лесник в анекдоте, устранивший обе соперничающие стороны за ненадобностью.

Первый вариант, как считает эксперт, видится куда более вероятным. 🤷♂️

В ХХ в. две мировые войны и немыслимое ускорение научно-технического прогресса еще более усилили это влияние. А с приближением третьей декады ХХI в. лавинообразный рост возможностей машинного обучения заставил говорить о спектре IT-технологий, объединенных метафорическим обозначением «Искусственный интеллект» (#ИИ) как о ключевом факторе экономического, геополитического и военного могущества ближайших десятилетий.

2018 год стал переломным. Ранее основное внимание СМИ, общества и политиков при обсуждении будущих угроз и вызовов развития ИИ было направлено на:

— грядущее вытеснение людей из многих профессий когнитивными агентами ИИ (роботами и программами);

— правовые и этические проблемы автономных ИИ-устройств (например, беспилотных авто);

— проблемы кибербезопасности;

— пугающе манящую перспективу то ли далекого, то ли не очень «бунта машин».

Однако в 2018 г. всё вдруг начало меняться. Перечисленные выше угрозы и вызовы не то чтобы исчезли, но потускнели на фоне происходящего осознания политиками и военными двух глобальных трансформационных трендов, которые можно условно назвать:

— ИИ-национализм

— ИИ-национализация

Сергей Карелов, основатель и Chief Technology Officer компании Witology, автор канала @theworldisnoteasy, в лонгриде для РСМД подробно описал тренды, сформулировал техно-геополитический прогноз

http://russiancouncil.ru/ai

Главными факторами международных отношений станут:

— ИИ-неоколониализм во взаимоотношениях стран-лидеров и стран-аутсайдеров в ИИ-технологиях;

— Гонка ИИ-вооружений между странами-лидерами, определяющая и направляющая дальнейшее развитие ИИ-технологий.

У такой гонки возможны 2 варианта окончания:

A. Вариант «Большая война», в результате которой следующая война будет вестись уже камнями и палками.

B. Вариант «AI Сингулярность» (или «приход лесника»), при котором все ускоряемое гонкой вооружений развитие ИИ-технологий породит «сильный» ИИ, а тот поступит как лесник в анекдоте, устранивший обе соперничающие стороны за ненадобностью.

Первый вариант, как считает эксперт, видится куда более вероятным. 🤷♂️

2018 October 10

А всё потому, что банально не хотят покупать ударные беспилотники у Турции и Китая. Вот в своё время купили у Израиля, теперь в России есть разведывательные БЛА. Израиль теперь вряд ли захочет продавать. Но Турция и Китай - почему нет?

А если чуть серьёзней, конечно очень впечатляет, что российский ВПК пока ещё делает по советской инерции истребители, но уже не способен сделать БЛА.

https://t.me/wingsofwar/1076

А если чуть серьёзней, конечно очень впечатляет, что российский ВПК пока ещё делает по советской инерции истребители, но уже не способен сделать БЛА.

https://t.me/wingsofwar/1076

В ходе шестимесячных испытаний в Танзании почтовый БЛА DHL Parcelcopter 4.0 совершил автономный полет с почтой на дальность 60 км на один из островов озера Виктория

Американцы оснастят боевые машины беспилотниками https://nplus1.ru/news/2018/10/10/shrike

2018 October 11

Возможно данное видео - испытания новых авиационных средств поражения для БПЛА.

Планируете забраться повыше? убедитесь в отстутствии авиакоридоров над вами.

https://fpln.ru/ Актуальное состояние воздушного пространства РФ, аэродромы, хелипорты, бесполётные зоны.

https://fpln.ru/ Актуальное состояние воздушного пространства РФ, аэродромы, хелипорты, бесполётные зоны.

Гражданские дроны на службе геодезии.

Рассказ о том, как в КРОК переделывают дроны, программируют полёт и затем всё обрабатывают, превращая снимки в детальные ортофотопланы, высокоточные трёхмерные модели местности и топографические планы: http://amp.gs/hK3h

Рассказ о том, как в КРОК переделывают дроны, программируют полёт и затем всё обрабатывают, превращая снимки в детальные ортофотопланы, высокоточные трёхмерные модели местности и топографические планы: http://amp.gs/hK3h